-

GAMEPOD.hu

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Petykemano

veterán

válasz

#45185024

#33600

üzenetére

#45185024

#33600

üzenetére

Abu!

Nem magyaráztad el, mit fogunk majd megérteni decemberben a vega jelenlegi frekvencia-feszültség paraméterezésében.

Én a sapphire kártya kapcsán nem értem. A sapphire most ah amdnél is hülyébb, hogy azt gondolják, hogy az övéké majd jobban fog skálázódni a frekvenciával? Vagy hogy a fogyasztási görbe kevésbé meredeken fog emelkedni?

Tudjuk, milyen fontos a perf /w mutató, a csapból is ez folyik. Azt is láttuk, hogy 10% teljesítmény különbségért 200w helyett 450w-tal kell fizetni.

Miért? Miért nem készítenem ehelyett a hősugárzó szörnyeteg helyett egy helyes energiahatékony kiscicát?Erre csak két reális magyarázat van:

1) más lapkához szabták a designt, itt csak újrahasznosítják az utolsó csavarig. És akkor már legyen kihasználva.

2) az AMD utasításait követik.De miért? Miért jó 10%-ért túlhajtani a kártyát gyárilag?

Vagy az AMD miért követeli meg ezt?

Driverből aktiválódik majd valami funkció, ami ugyanekkkora fogyasztás mellett 2x frekvenciát tesz lehetővé? KétlemA whitepaperben levő grafikont ismerem..ngg : 17x akkora cullint teljesítmény. Az nagyon szuper, ha csam a negyede igaz, akkor is. De ez csak azt teszi lehetővé, hogy a hardver ne dolgozzon amúgy nem látható pixelen. Ha a mhnka mennyisége csökken, az jó, mert ugyanazt az fpst kevesebb munkával elő lehet állítani, vagy ugyanannyi munkával több fspt.

Attól még túl van hajtva az optimális energiahatékonysági frekvencián felülre.

Játszhat még a pszeudo-channel mód. Éhezik a késleltetés miatt a Vega? De ha megjön a mód skálázódni fog?

Vagy van az architektúrának egy meghatározott része, amely rosszul skálázódik a frekvenciával? De na az ngg kivágja a munka egy részét, akkor nem lesz túlterhelve és skálágódni fog a frekvenciával?

Vagy egy új batchet kaptak a aib gyártók, ami már jobb szilikon?

Avass be a titokba, kérlek

[ Szerkesztve ]

Találgatunk, aztán majd úgyis kiderül..

-

válasz

Petykemano

#33603

üzenetére

Petykemano

#33603

üzenetére

Valamennyire kapcsolódik, amit Raja tweetelt még augusztusban. [link] és [link]

"There is a dilemma of whether the default setup be optimized for perf/$ or perf/watt. Ideally both..but.."

"Sales data tends to favor perf/$, but some opinions favor perf/watt. We tried to give user options to default based on their preference"

solfilo

-

válasz

Petykemano

#33589

üzenetére

Petykemano

#33589

üzenetére

Nagyon jó videó amit linkeltél, minden mondatával egyetértek, ajánlom én is mindenkinek, aki érteni angol.

[ Szerkesztve ]

-

#45185024

törölt tag

Költözik az AMD !

Áll e mára szent Klára vára ?

[ Szerkesztve ]

-

Z_A_P

addikt

Na, anno mondta AMD, hogy 3 nagyobb külső megrendelője lesz. Sony es MS, mar tudott. Állítólag jövőre fedik fel ezt a titkos megrendelőt. De azóta kiderult Intel (elobb cáfolták persze). Akkor nem o az? Aztan volt Tesla pletyka (cafoltak). Vajon o az? Aztán ott az Atari, ez állítólag fix. Ez lenne?

De ebbol csak a tesla jöhet jövőre mert a többi ismert. Vajon ebből valamelyik a nagy megrendelő? Vagy egy ujabb ismeretlen?OK

-

Petykemano

veterán

-

#45185024

törölt tag

válasz

Petykemano

#33609

üzenetére

Petykemano

#33609

üzenetére

Liza az új RTG főnökhöz:

-Képzeld végre megszabadultam attól a kétbalkezes Rajától .már majdnem nyereségesek lettünk amikor elejtette azt a Vegát !!!

A mellette levő élületből: Szijjjja LÍÍZAAAAAAAA (koduri)

-

TESCO-Zsömle

félisten

-

Z_A_P

addikt

-

GPU-t eddig is már csakis az AMD adott nekik szinte az utóbbi években...

Most meg a Ryzen végre CPU téren is versenyképes... kevesebbet is fogyaszt, mint a hasonló intelek... ergo simán egy APU-val kiváltható a csúcs mac gépek központi egysége, és elhagyható számos mobil vagy asztali CPU+ dGPU kombó is.

Lenne benne ráció váltani a kizárólagos intel vonalról.

Ebbe az egészbe csak az a nagy kérdőjel, hogy az apple igencsak függetlenítésre dolgozik minden téren... és hosszútávon, bizony a saját CPU+GPU játszik... GPU-juk már van ami hozható is akár desktopra is... már csak az x86-ot kell kilőni valami combosabb saját ARM procival és pápá intel meg AMD is.

[ Szerkesztve ]

Steam/Origin/Uplay/PSN/Xbox: FollowTheORI / BF Discord server: https://discord.gg/9ezkK3m

-

Abu85

HÁZIGAZDA

válasz

FollowTheORI

#33614

üzenetére

FollowTheORI

#33614

üzenetére

Vagy nem egyszerre csinálják meg a váltást, mert az túl sok lenne, ha egyszerre kilőnék a kompatibilitást a CPU és a GPU oldaláról. Például először behozhatják a saját IGP-jüket Semi-Custom AMD dizájnba, és ha ez a váltás megtörtént, akkor kevésbé megterhelő egy második körös ARM-ra való átállás.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Cathulhu

addikt

"Egyébként ha az Intel majd megpróbálja választás elé állítani a PC-s gamereket, hogy Intel vagy NVIDIA, nem vagyok benne biztos, hogy az Intel jönne ki győztesen."

Amibol megint csak az AMD jonne ki gyoztesen. Lehet kigondoltak ok ezt, mert ha ez tortenne, nem letezne gamer laptop AMD nelkul. De ez a vilag nem ennyire drasztikus, penz beszel, kutya ugat. Ld. Samsung vs Apple, megy a szajcseples, megis egymasbol elnek.

Ashy Slashy, hatchet and saw, Takes your head and skins you raw, Ashy Slashy, heaven and hell, Cuts out your tongue so you can't yell

-

#45185024

törölt tag

Nem akarom továbbhúzni a történetet csak mondom hogy a 3*8 PINesről kiderült hogy az a Zafír NEM 64 csak az 56 !

A 64 máshogy fog kinézni. Vizes???Abu85: Nem tudod véletlenül hogy hol van a Vega GPUban a hőmérési pont ?

Valaki azt írta hogy a HBM GPU T-pontjában.

Azért lenne fontos hogy vizezéskor be kell e kenni a réseket is ?[ Szerkesztve ]

-

Jack@l

veterán

Még egy dicsőséges nap a dx12 oltárán:

http://www.guru3d.com/articles_pages/star_wars_battlefront_ii_2017_pc_graphics_analysis_benchmark_review,7.html@Yany: nem ugyanúgy, rosszabbul, FCAT-ban is vannak szép nagy tüskék

[ Szerkesztve ]

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

-

Yany

addikt

válasz

Jack@l

#33621

üzenetére

Jack@l

#33621

üzenetére

Én ezt nem értem. Anno a DX12 előtt gigantikus driver overhead-ről papolt mindenki, erre egy DX12-es VGA pontosan úgy teljesít közvetlen API-val, mint az idejétmúlt dx11-gyel? Megint a driverre fogjuk? Arra a driverre, aminek már aligha van szerepe? Vagy mégis sok szerepe van és mégsem olyan vékony az a réteg? Vagy ráfogjuk a game engine-re, mert elavult? Ami most fog megjelenni? vagy ráfogjuk a fejlesztőkre, hogy nem vágják? Andersonostul, Mantle-stül? Ellentmondás ellentmondás hátán.

Szerk.: de most mondjátok meg, tényleg túl tájékozatlan vagyok, hogy ilyen "kekec" gondolataim támadnak és rég tudnom kéne, hogy "nem úgy van ám az..."?

Mert a bf4-nél még elment a szöveg, de azóta hány generáción vagyunk már túl hw és sw oldalon is...?

[ Szerkesztve ]

Építs kötélhidat - https://u3d.as/3078

-

Raymond

félisten

Nem az a gond hogy nincs driver overhead, mert van. Az a gond hogy mint sok minden mas is az nem az egyetlen dolog szamit igy a talalassal ellentetben nem fog akkora elony mutatkozni mint ahogy azt elkepzelik sokan, de mire ez kiderul addigra van mas amin lovagolni lehet.

Privat velemeny - keretik nem megkovezni...

-

#85552128

törölt tag

Számomra is meglepő, hogy mennyire szarul fut FB játékokkal a DX12 - főleg a Mantle után. Nem is az avg. FPS csökkenés a legnagyobb baj, hanem a konstans stutter meg akadozások. Nemhogy javítani nem sikerült rajta, de még rosszabb mint a BF1 egy évvel ezelőtt.

[ Szerkesztve ]

-

Cathulhu

addikt

Szerintem:

- Amig DX11-et is tamogatni kell, addig nem lesz igazan a DX12 kihasznalva.

- A DX12 amugy is rosszabb mint a Vulkan, kar eroltetni

- A Dice es a Frostbite mar egy ideje elvesztette a technologiai elonyet, egyre inkabb csusznak vissza. Remelem azert, mert kozben keszul egy uj verzio.[ Szerkesztve ]

Ashy Slashy, hatchet and saw, Takes your head and skins you raw, Ashy Slashy, heaven and hell, Cuts out your tongue so you can't yell

-

Abu85

HÁZIGAZDA

Per game specific driver paths...

Hasonló az AotS-hez, ahol a Dan Baker nemrég bevallotta, hogy csak azért működik a DX11 náluk, mert az AMD és az NV egyedi, játékhoz igazított implementációkat használ a driverben. Másképp nem működne.

A Battlefront 2 sem igazán natúr DX11, hanem van benne számos kiterjesztés az AMD és az NV szervizkönyvtáraiból. Ha a meghajtót is kialakítják rá úgy, mint az AotS-hez, és a hírek szerint kialakították rá, így nehéz a DX12-nek gyorsabbnak lennie, mert erre meg nem lehet így drivert írni, ugyanis nincs hozzá kernel driver.

Az egésszel egyébként csak az a probléma, hogy egy évben, maximum négy-öt ilyenre van kapacitása az AMD-nek és az NV-nek. Ha négy-öt játék jönne egy évben, akkor nem is kellenének a DX12/Vulkan hülyeségek.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Jack@l

veterán

válasz

Cathulhu

#33625

üzenetére

Cathulhu

#33625

üzenetére

De akkor kinél van az előny? UE4 nél is hajszálra ugyanez a szitu, pedig már évekkel ezelőtt belerakták a dx12-t.

Cryengine meg már fél lábbal süllyesztőben van, ők még talán kiizzadják magukból a támogatást. Kihagytam valamit, amivel AAA-s játékot készítenek? (hagyjuk a doomot most, konzolra írt grafika nem téma)[ Szerkesztve ]

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

-

Cathulhu

addikt

válasz

awexco

#33628

üzenetére

awexco

#33628

üzenetére

DX12 jatekoknal eleg lutri, hogy most elorebb vagy-e vele vagy sem. Vulkan jatekokbol meg joval kevesebb van ugyan, de az esetek nagy tobbsegeben gyorsabb a Vulkan mod, akar nVidiad van akar AMDd. Arrol nem beszelve, hogy platform fuggetlen.

Ashy Slashy, hatchet and saw, Takes your head and skins you raw, Ashy Slashy, heaven and hell, Cuts out your tongue so you can't yell

-

Abu85

HÁZIGAZDA

Igazából nem a DX12 mód a rossz, hanem a DX11 mód van gyártóspecifikusra kialakítva. Eleve ott kezdődik, hogy a Frostbite 3.5 GPU-driven pipeline, és ehhez AGS és az NVAPI multi-draw indirect kiterjesztését használják. Ez az alap, aztán használnak még egy csomó más, DX11-ben nem megtalálható kiterjesztést az említett szervizkönyvtárakból. De az egésszel már elég sokat spórolnak a többletterhelésen, mert a GPU-driven pipeline miatt alig van rajzolási parancs, csak ugye ez alapból nincs támogatva a DX11-ben, tehát külső szervizkönyvtár kell hozzá.

A másik amivel a DX12 nyer, az a kontroll, hogy a fejlesztő tudja mit csinál az alkalmazása, és aszerint menedzselhető a hardver. Na most igazából az AMD és az NV DX11-ben is meg tudja mondani, hogy mit csinál az alkalmazás, és például a Frostbite fejlesztői írhatnak olyan kódot, amihez az AMD és az NV külön specifikus meghajtóimplementációkat ír. Ez pusztán a végeredményben nem sokban fog különbözni a DX12-től. Az eltérés ott lesz, amikor jön egy új architektúra, és annak a hatékony kihasználáshoz kell egy külön patch, amihez külön kódokat kell megint írni a meghajtóba, míg a DX12 kód kvázi out-of-box működik. Ezt a modellt az AotS-nál próbálták ki először a gyártók, mert rá voltak kényszerítve, de egyre inkább átveszi más is. Ha így haladunk talán még binárist is engednek majd szállítani a GPU-gyártók. Remélem nem.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#33627

üzenetére

Jack@l

#33627

üzenetére

Na jó, de más belerakni, és tényleg értelmes szinten támogatni az API-t. Az UE4-nél nem nagy fókusz a DX12, mert úgyis a Vulkan lesz a fő leképezőjük, amire most állnak át. Az oké, hogy egy motor támogasson minden API-t, mert ez nem haszontalan dolog, de befektetés szintjén az a legjobb, ha egy explicit API-t kezelnek kiemelten.

(#33628) awexco: Igazából nem jobb. De nem sok különbség van, tehát végeredményben mindegy, hogy egy játék DX12 vagy Vulkan API-t támogat. Pár funkcióbeli eltérés van, ami közvetlenül érezteti a hatását a felhasználókra.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Yany

addikt

Azért ez elég gáz, amit írsz. Minimum 2 okból véleményes az egész, de lehet sokkal több gond is ezzel, csak most ezek jutottak eszembe:

1. Kvázi a DX12 előnyét fedik el és már közép távon is demarketingelik a modern apikat.

2. Versenytorzító hatású. Olyan játékok kapnak legacy API supportot, ami amúgy is erős stúdióval megy a háta mögött, míg a kisebbek nem kapnak specifikus optimalizálást.Mindegyik roppant káros és ez utóbbi jogilag is furának hat számomra. Vágom, hogy optimalizálások mindig is voltak, de itt már igencsak átlépnek egy vonalat.

3. --> HSM

[ Szerkesztve ]

Építs kötélhidat - https://u3d.as/3078

-

Jack@l

veterán

Azt már nyáron megkapta az UE4, nem nagyon eröltetették eddig a performance összehasonlítását a régi apikkal. (2016 februárban demóztak vele telefonon)

[ Szerkesztve ]

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

-

-Solt-

veterán

A DX12 valós előnye ott jöhetne ki, ahol még egy jó darabig biztosan nem lesz alkalmazva... Például ArmA, vagy repszimek garmadája, ahol 10+ kilométeres látótávok vannak. ArmA3 alatt a látótávot felhúzom 5 km fölé és bármilyen VGA mellett összeszarja magát a CPU limittől.

Az ilyen 1-1,5 km látótávval rendelkező AAA címekben ahol évről évre semmi nem változik pár látványelem kivételével, nem sok előnye lesz a DX12-nek... főleg, ha folyamatosan GPU limit van.

www.smart-bus.hu

-

#45185024

törölt tag

válasz

-Solt-

#33637

üzenetére

-Solt-

#33637

üzenetére

Igen csak azokat az 1 km fölötti távolságokat Te felrakhatnád egy henger belső falára és máris nem akad semmid csak persze ha úgy csinálnád nem kellene a csúcskártya a FANnak. Az eltérés meg szinte érzékelhetetlen. De valami misztikus okból mindig 4k 60 FPS vagy full hd 140 fps a top kártyával

[ Szerkesztve ]

-

Kristof93

senior tag

válasz

#45185024

#33638

üzenetére

#45185024

#33638

üzenetére

Ezt azert hagyd a fejlesztokre, mert nagyon nem igy mukodik.. Szimulatorokon, rts-en, es egyebb nyilt vilagu jatekokon hatalmasat dobna a dx12. Pl. Arma, KSP, Cities Skylines. A konzolok harmat gyenge processzorai miatt kevesbe latni jelenleg, pc exkluziv cimeknel pedig nem nagyon hasznaljak.

-

Z_A_P

addikt

válasz

FollowTheORI

#33614

üzenetére

FollowTheORI

#33614

üzenetére

I asked if it’s too soon to talk about next semi-custom projects. She said there is “one additional design that will ramp in the second half of 2018,” and said AMD will wait until the customer is ready to discuss that project. I asked what industry it might be in, and Su replied “let’s just call it embedded."

Na erre céloztam: ez lenne az Intel?

Atari? Apple?[ Szerkesztve ]

OK

-

#45185024

törölt tag

Megint drágulni fog a szilícium lapkák gyártása 2018-ba is 19-be is.

Silicon Wafer Price Squeeze As Demand Further Outstrips Supply

[ Szerkesztve ]

-

Cathulhu

addikt

Ashy Slashy, hatchet and saw, Takes your head and skins you raw, Ashy Slashy, heaven and hell, Cuts out your tongue so you can't yell

-

Z10N

veterán

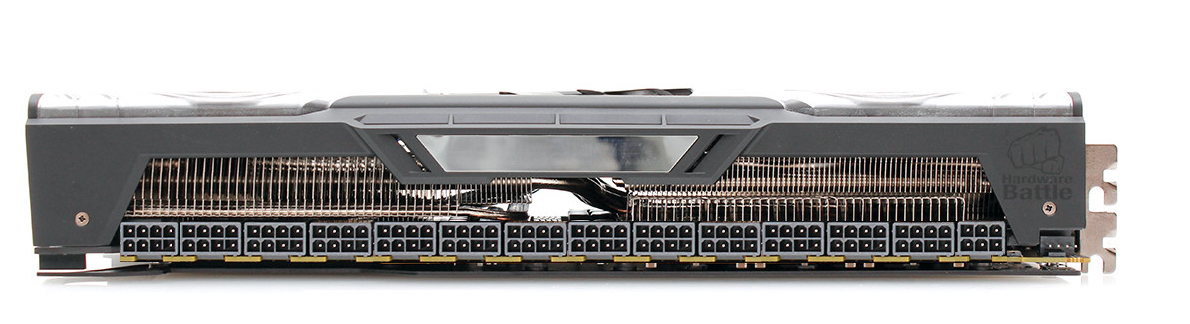

PowerColor Radeon RX Vega 64 Red Devil

Ui: Erdekes lesz majd a Vega Nano-t figyelni, hogy mennyire fogjak majd vissza ezek alapjan.

[ Szerkesztve ]

# sshnuke 10.2.2.2 -rootpw="Z10N0101"

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

![;]](http://cdn.rios.hu/dl/s/v1.gif)