- Senua's Saga: Hellblade II - Íme a végleges gépigény

- Marvel Snap

- Egyre nagyobb a balhé a Helldivers II körül

- Konzolokról KULTURÁLT módon

- Counter-Strike: Global Offensive (CS:GO) / Counter-Strike 2 (CS2)

- Fallout 4

- EAFC 24

- Call of Duty: Modern Warfare III (2023)

- Genshin Impact (PC, PS4, Android, iOS)

- Helldivers 2 (PC, PS5)

Új hozzászólás Aktív témák

-

Petykemano

veterán

válasz

FollowTheORI

#41698

üzenetére

FollowTheORI

#41698

üzenetére

Abban igazad van, hogy a grafikonon nem látszik, hogy a látvány mennyiben javult és lehet, hogy a számok sem tartalmazzák a DLSS jótékony hatását az FPS-re.

Ehhez két megjegyzés:

- Az RT és tensor magok a lapkaméretet ugyan foglalják, de ha nincsenek használatban, akkor nem is nagyon kéne fogyasztaniuk szerintem. Tehát a magas fogyasztást natív módban RT nélkül nem ezek a technológiai újítások okozzák.

- Néhány éve, amikor abu azzal védett egy AMD technológiát, hogy az az újabb motorokban fog hasznosulni, akkor azt nagy köpködés követte, hogy hát az ember nem azért vesz videokártyát, hogy csak az új játékokkal játszon, hanem hogy az elmúlt 5-10 évből mindennel és hogy az, hogy egy technológia csak az újabbaknál jelent előrelépést/gyorsulást az elfogadhatatlan.Ezzel együtt biztos vagyok benne, hogy az upscaling az új irány - függetlenül attól, hogy az valamilyen neurális háló (DLSS) vagy más algoritmus eredménye.

[ Szerkesztve ]

Találgatunk, aztán majd úgyis kiderül..

-

válasz

Malibutomi

#41696

üzenetére

Malibutomi

#41696

üzenetére

Gondolom értelmesebb lenne a 3080 kártyát nézni, és konkrétan a 3090 ről beszélned , nem pedig egybefüggően az Ampereről, mint termécsalád mert a 3080 meg az egyik legjobb előrelépést produkálta még perf / watt terén is.

Vagy arról is beszélhetnénk, hogy a 3 utolsó AMD kárty a 3080 hoz képest 10 % fejlődést mutat teljesítényben.A 3090 pontosan azt képviseli amit a Radeon VII képviselt, elsősorban munkára éri meg ,nem pedig játékra ha ár / értéket nézünk. Úgy gondolom nem véletlenül lett ekkora szakadék a két Ampere között. A 24 GB ramjával és az NV linkkel konkrétan félprofeszionális felhasználásban feleslegessé tette a Quadrokat.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

az én képeimen mit látsz és miről beszéltem az első bekezdésben ?

akkor roszabb szerinted ha 10 % kal jobb? vagy a 2080 superhez 19 % kal jobb?[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Mumee

őstag

"3080 meg az egyik legjobb előrelépést produkálta még perf / watt terén is."

Az első képeden az "energy efficiency" oszlop, 2. képeden energy efficiency (perf per watt) sor.

2080ti 90,6% 3080 100% azaz kb. 10%-al jobb a perf/watt a 3080-nak.

A 3090 még jobb is ebben a vonatkozásban, hisz nem igazán fogyaszt többet, de gyorsabb így ki is jön a Malibu képen a 13% a 2. képén 2080ti vs 3090 perf/watt.Malibu 1. képén pedig csak teljesítményugrásról van szó.

A 3090 FE kb. 46%-al erősebb, mint a 2080ti FE.

Az általad linkelt 2. képen alul lehet következtetni a 4K és 4K+RT 3080 vs 2080ti eredményekből, ami 31% és 40% átlagolva 35,5% és a 3090 egy ~10-15%-ot ver a 3080-ra.

Így a 46% 2080ti vs 3090 a Malibu ábráján megint csak korrektnek nevezhető. -

értem de mi a ..nak magyaráztad ezt el nekem most? elolvastad egyáltalán a kommentemet ? azt írtam hogy nem az Ampere családról kellene beszélnie áltaáosíta hanem konkrétan a 3090 ről mert a 3080 ra már nem igazak a fentiek,adott kártyához viszonyítva .1080-2080-3080

ezt írta :

" A nagy hype utan itt latszik hogy az Ampere a harmadik legkisebb elorelepes az NV torteneteben es az egyik legrosszabb perf/watt -ban is."

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

-FreaK-

veterán

Én kérek elnézést, de a 3080 is kb. ugyan ott van perf/watt előre lépésben mint a 3090, nem lehet túl nagy a difi. Így aztán az idézett kijelentés megállja a helyét. Amennyivel gyorsabb lett, annyival többet is fogyaszt, illetve egy minimális javulás következett csak a be a kettő arányában. Ez ugyan úgy igaz a 3080-ra, mint a 3090-re.

[ Szerkesztve ]

-

FLATRONW

őstag

Ha abból indulunk ki, hogy a Maxwell egy nagyon jól sikerült sorozat volt, akkor nem is olyan rossz az az ugrás, ami a 3090-nek sikerült.

-

Nem. Ezt csak akkor lehetne így nézni egymás után ha azonos kürülmények vannak minden diffi mérésnél.

Tehát a 780 veri az 580-at 100%... de milyen körülmények között... ez a 100% diffi ugyanakkora terhelésbeni diffi mint a 2080Ti és 3090 közötti 46%?

Kötve hiszem... előbbi mondjuk 1080p-ben van mérve RT meg minden nélkül... utóbbi meg 4K + RT például...

Ezután merész kijelenteni hogy a harmadik legkisebb előrelépés, és erről ábrát gyártani.

Kérnék egy 580 vs 780 4K + RT eredményt.

Szóval érted hogy mit támadok és miért nem?

Ezek a százalékok így nem összemérhetőek... ennyi.

[ Szerkesztve ]

Steam/Origin/Uplay/PSN/Xbox: FollowTheORI / BF Discord server: https://discord.gg/9ezkK3m

-

arról abszlút nem tehetek hogy 3 hozzászólásban kell neked kifejteni mit írt a kollega és mit írtam én.

"Nagy hype utan itt latszik hogy az Ampere a harmadik legkisebb elorelepes az NV torteneteben "

nem az Ampere mint család, hanem a 3090 mint csúcskártya- A 3080 a 2080 hoz és 69 % -t lépett előre a superhez 58 % ot.

mert 2090 volt ?

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Yutani

nagyúr

válasz

FollowTheORI

#41710

üzenetére

FollowTheORI

#41710

üzenetére

A generációs ugrások összevethetők, mert az adott kor viszonyai között voltak mérve. Akkor vették újonnan a friss terméket, az akkori játékokban teljesítettek úgy egymáshoz képest.

Nincs olyan játék, amivel korrektül össze tudod hasonlítani az elmúlt 10 év csúcskártyáit, mert akkora a sebesség különbség, hogy valahol torzítani fog.

#tarcsad

-

Mumee

őstag

válasz

Yutani

#41712

üzenetére

Yutani

#41712

üzenetére

+

Illetve ehhez tenném hozzá, hogy adott generáció top gamer kártyája mutatja az adott architektúra csúcs teljesítményét és azért nem gondolom korrektebb összehasonlításnak az alsóbb ház termékeit, mert míg a 2080 a 104-es lapka top terméke, addig a 3080 már a 102-es lapka vágott terméke.

Így mivel árat nem nézünk, sokkal torzabb képet ad még annál is, mint amit FollowTheORI említett.Így vagy úgy minden összehasonlításba bele lehet kötni többé-kevésbé jogosan, viszont az nagy számok törvénye alapján így egy korrekt összképet mutat.

-

Raggie

őstag

Szerintem sincsen megfelelően nagy teljesítményszintbeli ugrás a mostani NV generációnál.

Ettől függetlenül az ilyen összehasonlítások nagyon sok tényezőtől függenek, és nagyon torzíthatóak, kb amit ki szeretne hozni belőlük a tesztelő az fog kijönni...

És a nagy számok törvénye teljesen más, ne keverd ide.

Clint Eastwood FTW

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#41701

üzenetére

Petykemano

#41701

üzenetére

A fogyasztást a mai hardvereknél eleve a fogyasztási limit befolyásolja. Ha befogásra kerülnek a nem használt részegységek, attól a fogyasztási limit nem változik, maximum nem x MHz-es tartományban lesz az órajel, hanem x-200 MHz-esben.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Mumee

őstag

válasz

Raggie

#41714

üzenetére

Raggie

#41714

üzenetére

Mivel sok különböző oldal tesztjeinek átlaga van feltüntetve a grafikonon, így kellőképp helytálló a nagy számok törvénye szerintem.

Ezt írtam is, hogy sokféleképpen torzítható, azonban a grafikon több oldal tesztjei alapján készültek, az adott generációváltás idején. Ennél nem nagyon tudsz kevésbé torz képet kapni.

Amúgy HUB (hardware unboxed) is ezt a 3080 vs 2080-at hozta fel és ott is írták, hogy két különböző tier-ben készült SKU összehasonlítása igencsak problémás és a generációs ugrás-ra értelmezhetetlen adatot ad, ha nem azonos SKU-kat hasonlítunk.

Belinkelem csak, hogy legyen nyoma miről írok (igaz elírta a saját tesztjeik alapján is a számot, ha jól írták akkor 69%-nak kellene lennie)

Tehát így beillene a a jó generációváltások közé, ha a fent említett gond nem lenne az összehasonlítással.

-

Mumee

őstag

1 socket mínusz.

Azt hiszem én összetörtem volna valamit helyben.

[link] -

[Nvidia Maxine]

AI videóhívás[Nvidia lays out plan to create new kind of data center chip]

És jön az első Mellanox- ARM -Nvidia gyerek hogy Intelt megszorongassa.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Kezdődik:

[Intel Slips, and a High-Profile Supercomputer Is Delayed( Aurora)]na vajon melyik cég viszi el a zsíros falatot?

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

szmörlock007

aktív tag

Hát nem tudom elviszi-e valaki, utána úgyis jön 2 exascale gép fél-1 évvel, meg ha jól veszem ki akkor az Aurorát nem törlik csak csúsztatják, ergo Intel marad annak a beszállítója, persze ez változhat ha úgy van. Intel az egyetlen megmaradt Chip gyártó az Usa-nak, a másik 2 tajvani meg dél-kóreai, ergo nekik fontos lenne, hogy az Intel talpra álljon, mert elég nagy stratégiai hátrány lenne, ha a későbbiekben nem lenne legalább 1 amerikai cég fejlett gyártástechnológiával. Persze emellett a Tsmc-vel és a Samsunggal is eléggé baráti viszonyt kezdenek ápolni, biztos ami biztos. Nem hiába az Intel az első (vagy egyik első) cég aki szállíthat a Huaweinek. Kicsit támogatni fogják őket most ezt biztosra veszem.

[ Szerkesztve ]

-

válasz

Kolbi_30

#41734

üzenetére

Kolbi_30

#41734

üzenetére

Azok más kontextusban vannak megemlítve a cikkben, mint gyártók. Mondjuk érdekes, hogy a NYT felhozza hogy már az is problémásnak tűnik az USA-nak hogy Taiwan és Dél korea előrébb tart gyártástechnológiában és nem akarnak csak tőlük függeni.( Kínaeffektus lesz ebből a végén )

két lehetőség van :

Nvidia A100 és AMD MI100 vagy több év csúszás.

Ez pontosan annak a játéknak a kezdete amiért felvásárolta Nvidia az ARM ot és lesz még ilyen bőven.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

szmörlock007

aktív tag

"Nvidia A100 és AMD MI100 vagy több év csúszás."

Hát meglátjuk, én azért még nem látom ennyire pesszimistán, jelen állás szerint 1 évet csúszik maximum, mint a 7nm, persze lehet további fennakadás. Persze ez mindenképp probléma az Usa-nak, mert lehet Kína pont ezért fog hamarabb exascale-es gépet építeni, de legalább hátha minden intel igazgatótanácsbeli tagban tudatosul, hogy egy tech cégnek állandóan fejleszteni kell gőzerővel.

Esetleg Amd építhet még egyet 2021-re ha nagy baj lenne

A Genoa meg a Cdna2 amúgy is 21 végére van ígérve.[ Szerkesztve ]

-

Petykemano

veterán

-

Abu85

HÁZIGAZDA

Az Aurora nem tud módosulni. Az Exascale rendszereknél nagy problémát jelent, ha nem koherens interfésszel vannak bekötve a gyorsítók. Egyszerűen túl nehéz ilyen szintre skálázni egy konfigurációt. Tehát marad az Intel gyorsítója, csak nem az Intel fogja gyártani hozzá a Compute Tile-t, hanem a TSMC. Ennyi lesz a változás. Ez valószínűleg kisebb teljesítményt jelent majd, így az Intelnek el kell döntenie, hogy több hardvert szállít-e, vagy azt csinálják, hogy marad a tervezett rendszer, és idővel ingyen kicserélik a gyorsítókat nagyobb teljesítményűre.

AMD-re, NV-re, akármire nem lehet váltani. Egyrészt azzal dobni kellene a host rendszert. Tud ugyan másik memóriakoherens platformot kínálni a Cray, de akkor nem teljesül a CORAL-2 program követelménye, tehát AMD-re nem tudnak átállni. NV-vel pedig a tervezett teljesítmény töredéke jönne össze csak.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

válasz

Petykemano

#41738

üzenetére

Petykemano

#41738

üzenetére

Én pont azt gondolom, hogy AMD vagy Intel.

Ha mos lenne amúgy kész ARM rendszere nvidiának valószínűleg az övék lenne.

Vannak tök jó cikkek erről. Úgy gondlom amúgy ha ez a projekt kicsúszik Intel kezéből egy lavinát indít el, és erre vár Nvidia és AMD is.

Ahogy írja Abu jelenleg Nvdiának csak az IBM lenne, de az messze van szükséges teljesítménytől.Intel és Nv kombó esetleg...

3 lehetőséget látok.1,Ha AMD időben kész lesz a Frontierrel, még akkor lehet esélyük arra ,hogy ezta projektet is megoldják, elöbb mint Intel. Ha az USA bevállalja a blamát és leváltja teljesen ebben a beruházásban Intelt. A tervek szerint 500 millió dollárból lehetne meg pluszban ez a váltás, amit szerintem még bevállalnának ha csak ezen múlna.

2, Várnak Intelre és csúszik a projekt, de álítólag örjöngenek már a megrendelők és jönnek a hírek, egyre többen elhagyták Intelt a megbízott mérnökcsapatból,.

Nagy érvágás volt hogy az egyik legfontosabb emberkéjük ebben a projektben és teamben felállt és átment a Micronhoz.3, Van olyan vészforgatókönyv, hogy megkérik Nvidiát tervezze át az A100 -at az Intelhez és biztosítsa a két cég a megfelelő koherens összekötetéshez szükséges hátteret. van az a pénz ...

Eza legmerészebb ötlet,de van olyan vélemény is , hogy ez azért lenne , mert nem akarják hogy ezt a projektet is AMD valósítsa meg , mert nem bíznak bennük teljesen valamint nem szeretnék, hogy egy cég kezében összpontosuljon az összes fontosabb rendszerük.

Addison Snell ezt szeretné, ebben bízna ,de egyre jobban derülnek ki a dolgok, hogy az One APi még sem olyan mint ahogy a kékek előadták...Érdekes játék lesz az biztos de a leglogikusabb az lenne ha várnának még vagy AMD lenne teljesen, aka Frontier. Jelenleg egyre kevésésbé bíznak az Intelben hogy ha sikerül is a Ponte, az valóban hozza azt a teljesítményt amit ígérnek és úgy néz ki addigra AMD és Nv is szintet lép ráadásul.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Az IBM magjai lényegesen erősebbek az ARM és az Intel/AMD magjainál. És a rendszerük teljesítménye is nagyon magas. Olyannyira, hogy nem igazán tudja őket közelíteni az ARM vagy az AMD/Intel. A probléma leginkább az, hogy nem x86/AMD64 az ISA.

1. Az Intelnél ezt bárki később tudja szállítani, még az AMD is. Hiába tud a Cray adni egy másfajta rendszert. A leggyorsabban akkor van meg az Aurora, ha az Intel szállít nekik TSMC-nél gyártott gyorsítót. Mindenki más csak lassabban tudja összerakni a rendszert.

2. Ez a projekt már eleve csúszik. Évek óta kész kellene lennie, csak az Intel törölte a Xeon Phit.

3. Az 3 év legalább. Ha csak a pénzen múlna, akkor már megkérték volna, de a chiptervezés problémája az idő. Ráadásul mire raknak CXL-t az A100-ba, addigra ez a lapka rég elavul, és sokkal újabb rendszerek lesznek kész. Ez nem olyan dolog, hogy kell a funkció, és az NV megoldja fél év alatt. Le kell ülni a tervezőasztalhoz, és egy csomó mindent ki kell cserélni a dizájnban, ami kb. egy év meló, majd két év mire azt tömeggyártásra alkalmassá teszik.

Az, hogy Addison Snell mit szeretne az irreleváns. A DOE meg azt szeretné, ha az Aurora 2022-ben működne, és azt csak az Intel tudja biztosítani. Minden más lehetőség további csúszás. Az AMD ezt nem fogja tudni vállalni 2023 előtt, az NVIDIA pedig 2025 előtt.

Mondjuk a top Ponte Vecchio eleve 40 TFLOPS-ra lő, tehát ha abból 30-35 jön össze, akkor az is elég jó még. Ráadásul az Aurora konfigurációja az 6 GPU-s, tehát 50 TFLOPS-ot egy szerver node TSMC-vel is tudni fog. Az AMD-nek a CDNA-ja 40 TFLOPS körüli. FP64 ezeknek a számoknak a fele. Az NVIDIA nem tudni, hogy hoz-e valamit az A100 mellé, mert az általános számításban nem valami erős, csupán 19,5/9,75 TFLOPS-ot tudnak vele FP32/64-ben.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Értelek, ezeket a dolgokat nem én találtam ki, általuk és hírportálok által nyilatkozott infók összesítése ,de egyetértek veled nagyjából.

Közben Intel nyilatkozott, hogy nem viszi át TSMC hez a gyártást."A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Itt sem árt:

Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

-

gejala

őstag

válasz

huskydog17

#41744

üzenetére

huskydog17

#41744

üzenetére

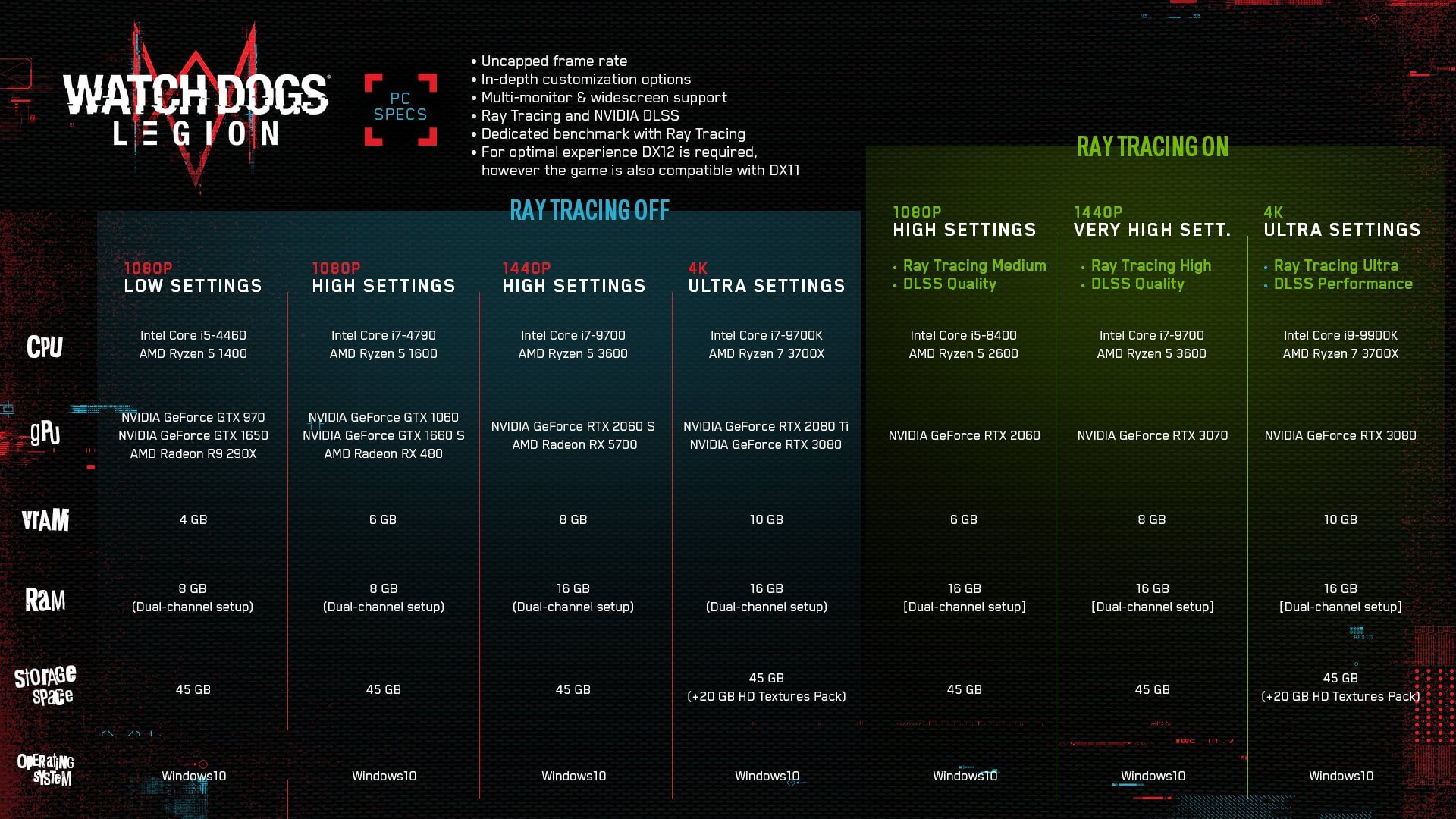

Szeretem az ilyen gépigényeket, amikor a felbontás növekedésével egyre gyorsabb CPU kell.

Na meg, hogy 3070-t ajánlanak, miközben a játék előbb lesz kapható, mint a kártya.

Na meg, hogy 3070-t ajánlanak, miközben a játék előbb lesz kapható, mint a kártya. ![;]](//cdn.rios.hu/dl/s/v1.gif)

[ Szerkesztve ]

-

Malibutomi

nagyúr

válasz

huskydog17

#41744

üzenetére

huskydog17

#41744

üzenetére

Jol nez ki.

A grafika nem ugy nez ki ami szuksegesse tenne ekkora gepigenyt, a VRAM szukseglet mindenhol pont akkora mint az NV kartyake, es ahogy masok is irtak magasabb felbontashoz erosebb proci?

Jo nagy BS ez. ELegge sokat tejelhetett az NV erre a jatekra.

[ Szerkesztve ]

-

válasz

gejala

#41745

üzenetére

gejala

#41745

üzenetére

Nincs itt semmi látnivaló. Minden játéknál így van, nem csak az Ubinál, hogy a hivatalos gépigénynél magasabb beállításokhoz (ésm agasabb felbontáshoz) erősebb CPU ajánalanak. Még egyszer ez MINDEN játéknál így van, még a kiválóan optimalizált Doom 4 és 5 esetében is.

#41747 Malibutomi: Nálad se értem miért csodálkozol azon, hogy nagyobb felbontáshoz/beállításhoz erősebb CPU-t ajánalak, amikor MINDEN más játékban is így van, nézd csak meg például a Doom 5 gépigényét, ott sincs másképp, szóval totál nem értem, hogy ezen mit kell fennakadni, úgy teszel, mintha soha életedbe nem láttál volna még hivatalos gépigényeket. Ez teljesen megszokott.

Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

-

Serious Sam 4 Benchmark - ComputerBase

Röviden: a játékban van három API: DX11, DX12, Vulkan -> Vulkan nyert

Vega utálja a DX12-t -> azonnal összeomlik

A többi AMD kártyán a DX12 mód lassabb, mint a DX11.Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

-

gejala

őstag

válasz

huskydog17

#41749

üzenetére

huskydog17

#41749

üzenetére

Hát ennyit a FineWine technológiáról. Úgy tűnik, már AMD se fejleszt drivert a Vegára.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

Állásajánlatok

Cég: Ozeki Kft.

Város: Debrecen

Cég: Promenade Publishing House Kft.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)