-

GAMEPOD.hu

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Yany

addikt

Na igen. Pedig azt gondolom, hogy nem szükségszerűen "inferior" a termékük, ez a szomorú. Technikailag tök rendben van szvsz, a qc hangsúly és az erőforrások általában rossz helyre mennek ott, gyanítom más piacokra koncentrálás okán, csak hát a hírt a gamerek viszik, ők a hangosak, ha itt nem teljesít jól, a többi piacon is hasonlóan romlik a megítélés. Na én egy ilyen "terméket" várok AMD-től, ahol ezt felismerve tesznek bele apait, anyait.

Kicsit olyan a szitu, mint a boxban: látod a két félen, hogy melyik a domináns és melyik a túlélésre játszó, már az arckifejezésekből. Elég a nyilatkozatokat, a fiaskók miatti magyarázkodásokat és a "nagy" bejelentéseket figyelni, hogy lássuk ezt az arckifejezést. A szájuk hazudik, de az arcuk őszinte.

Építs kötélhidat - https://u3d.as/3078

-

Petykemano

veterán

Szerintem a "loss of consumer credibility"-n és a "brand damage" nem csak azon múlik, hogy a cég mit csinál. Hanem azon, hogy azt hányan és milyen módon interpretálják. Az Nvidia miért ússza meg a "brand damage" és "loss of credibility" nélkül azt, hogy a bemutatóin rendre számottevően nagyobb számokkal ámítja a közönséget? (pl: 3 x 3090) és persze ebből lehet, hogy mém lesz, de ennek ellenére a Nvidia nem néz szembe olyan számonkéréssekkel, mint amikkel az AMD.

KÍsértetiesen hasonlít a magyar politikai közéletre, amelyben az jelenti ma a pártatlanságot, el nem kötelezettséget, mérvadó középen állást ha valaki cinikusan röhögcsél az ellenzék alkalmatlanságán, vagy legjobb esetben is korholja, hogy miért nem szedik már össze magukat, de ha kormány dolgainak számonkéréséről van szó, akkor ¯\_(ツ)_/¯. Persze bármit el lehet mondani, csak minek? És éppen ezért változást is a másik - alkalmatlan oldalon kéri számon.

(Elnézést a kis kitekintőért, de fontos alapozója a következő gondolatnak)Ennek megfelelően egy átnevezésnek imázsváltásnak pont annyi haszna/eredménye lenne, mint egy új politikai párt indításának.

Egyébként a kis történetből a nekem az jött le, hogy papírbolt és a szemközti más márkanév alatt nyitott, de egy tulajdonoshoz tartozó konkurencia az NVidia és AMD analógiája.

[ Szerkesztve ]

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

De mi az ok és mi az okozat?

A botrányok azért hosszú életűek az AMD esetében, mert hibáztatjuk őket értük, míg az Nvidiát nem. De valóban annyival gyakrabb és annyival jelentősebb az AMD oldalon elkövetett hiba, mint az Nvidia oldalon? Vagy azért emlékszünk ezekre hosszú életű és jelentős botrányokként, mert örökös felemlegetésükkel tesszük örökkön örökké megbocsáthatatlanná. Nem magyaráztad meg, hogy az Nvidiára ezek az ügyek miért nem égnek rá (a tápcsatlakozó esetén szó szerint) megbocsáthatatlan botrányokként.

Persze én azt elismerem, hogy az underpromise-overdeliver a jól működő, jó benyomást keltő hozzáállás.

De miért van az, hogy az Nvidia következetesen, több generáció óta másfél-kétszer nagyobb előrelépést hazudik az anyagaiban, mint amit aztán a valóságban kimérnek és ebből nincs botrány. De ha az AMD-nél 15%-ponttal lemaradnak az ígértettől és a következő 5-10 évben mindenki emlékezni fog arra, hogy az AMD elqrta az RDNA3 piacravitelét.

5 év múlva szerinted ki fog emlékezni (mármint úgy, hogy felemlegeti, mint érvet) még az NVidia tápcsatlakozós problémára? Nagyjából egy-két elvetemült AMD fan. De még 5 év múlva is az AMD orra alá lesz dörgölve a Polaris PCie áramfelvétele."kutyát nem érdekli, hogy a slide-okon"

De Miért?

És arra miért van pattanásig kifeszülve mindenki, hogy az AMD slide-jain mi van?Természetesen abban igazad van, hogy a márka megítéléséhez az emlékezetben élő botrányok hozzájárulnak. De szerintem nincs nagyságrendi különbség az AMD és az Nvidia hibáiban, csúsztatásaiban, driveres problémáiban. Időről időre itt is, ott is felbukkan egy kummantó slide, egy bugos driver, egy hardverhiba. És az emlékezetben mégis az marad meg, hogy az AMD folyamatosan bénázik, az Nvidia meg király.

Találgatunk, aztán majd úgyis kiderül..

-

Abu85

HÁZIGAZDA

Az open source egy stratégia. Az NVIDIA is megy az open source felé, lásd Linux meghajtó megnyitása, mert rájöttek, hogy bizonyos piacokon fel sem kerültek a potenciálisan megvásárolható hardverekhez, mert nem volt open source stratégiája. És ezek a piacon már dollármilliárdos szintre nőttek. Ez géming szempontból is hasznos, mert a Steam Deck az open source miatt létezik.

Emellett nagyon sok open source Vulkan/D3D12 projektje van az AMD-nek, amik nélkül egy csomó játék nem is létezne úgy, ahogy létezik. Például ma már tipikus, hogy a top stúdiók sem írnak saját memóriamenedzsmentet, hanem letöltik ezeket: [link] , [link] - utólag lehet módosítani a forráskódot. Az előző évben az összes Ubisoft és Activision cím ezekkel jött, és idén már egy csomó EA cím is átáll erre a fejlesztési modellre. Például a Star Wars Jedi Survivor. Szimplán sokkal olcsóbb az AMD által megírt kész kódot felhasználni és finomhangolni, mint írni a nulláról egy sajátot. Ráadásul új dolog, hogy az újabb VMA és D3D12MA verziókba már az Intel is optimalizál, vannak kódrészek, amiket a saját Arc hardvereik miatt adtak hozzá. Rájöttek, hogy nem tudják lebeszélni róla a fejlesztőket, így beálltak ők is fejleszteni a kódot. Ez egy stratégia.És nem csak a memóriamenedzsmentet egyszerűsítik, hanem az egész Vulkan és DirectX 12 használhatóságát, ugyanis van egy új RPS SDK-juk. [link] Ennek tipikusan az a célja, hogy ha egy indie nem akart explicit API-ra váltani, mert túl bonyolultnak tartotta, akkor használjon RPS SDK-t, és úgy használhat explicit API-t, miközben az alkalmazásának bonyolultsága nem lesz nagyobb a DirectX 11-nél.

A képen látható is, hogy a fejlesztőnek nem kell azokat a sárga bonyolult dolgokat megírni, egyszerűen az RPS SDK megcsinálja helyette automatikusan. Ráadásul nem is szarul, mert az AMD mérései szerint 58 explicit API-t használó játékból 54-nél gyorsabb volt az alap kódnál az RPS rendszer. Tehát még a top fejlesztők számára is elgondolkodtató a használata, mert nem kell másfél évet szenvedni az optimalizálással, megoldható két hét alatt az SDK implementálásával, és mindent automatikusan csinál az RPS. Azt persze hozzá kell tenni, hogy az RPS licenc az nem MIT, tehát ott azért vannak kérdőjelek, de majd kiderül, hogy a végleges verzió milyen licencet kap.A stratégia az egész mögött annyi, hogy ha valaki fejleszt egy D3D12/Vulkan játékot, akkor ne is írjon saját memória-menedzsmentet, erőforrás-kezelést, ütemezést a GPU munkafolyamatokra és az erőforrás-korlátozásra, hanem töltse le a VMA/D3D12MA és RPS kombót, oszt kész. Az AMD előre megírt, minden hardveren működő (NV-n és Intelen is), több tízezer sornyi, bármilyen motorba beilleszthető kódot ad, amit később lehet módosítgatni a nyílt forráskód miatt. Persze, ha valaki akar ezzel foglalkozni. És tekintve, hogy a VMA/D3D12MA mennyire bevált, az RPS is kb. arra számíthat, hogy menni fognak érte. És ugye az NV és az Intel is fejlesztheti, hiszen ott a forráskód a GitHub-on. Az Intel már fejleszti is a VMA/D3D12MA-t.

És ez a fajta stratégia nagyon bevált eddig, mert tök egyértelmű a fejlesztők felé az üzenet. Miért akarnál 30-40 ezer sornyi kódot megírni, amikor le is töltheted, és helyből gyorsabb lesz minden elérhető hardveren, mint amit írni tudnál másfél év alatt?

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Ezzel az AMD leginkább azt tudja elérni, hogy azok a kódok, amelyeket a játékok alkalmaznak, jók lesznek Radeonon, mert ugye a saját maguk által megírt menedzsment kódokat használja a játék. Tehát például a day0 driver support is leegyszerűsödik, mert ugye nincs szükség külön profilra, ami ilyen-olyan dolgokat cserélne. Out-of-box működik az így megírt játék, anélkül, hogy egy fillért is költöttek volna rá a driver oldalán.

A driveres erőforrás elköltése egy sarkalatos pont, mert az AMD egy ideje azt csinálja, hogy évente legalább egy nagyobb frissítést hoznak új funkciókkal, és ahhoz egyébként kell ám a humánerőforrás, mert a Chill, a Boost (VRS), az Anti-Lag, stb. dolgokat nem a hangyák hordják bele a driverbe.

Tehát minél több erőforrást meg tudnak spórolni a teljesítménycentrikus kódokkal, és a hatékonyabb fejlesztési modellel, annál több újítást tudnak hozni a driverbe. Ez különösen fontos manapság, hogy hozzáférnek egy rakás Xilinx technológia forráskódjához, amelyből elkezdtek szelektálni, hogy mit portoljanak át PAL-ra és/vagy a Tensilica DSP-k IR-jére. A Content Adaptive Machine Learninggel kezdtek, de van még ott más is.

Tehát minél több erőforrást meg tudnak spórolni a teljesítménycentrikus kódokkal, és a hatékonyabb fejlesztési modellel, annál több újítást tudnak hozni a driverbe. Ez különösen fontos manapság, hogy hozzáférnek egy rakás Xilinx technológia forráskódjához, amelyből elkezdtek szelektálni, hogy mit portoljanak át PAL-ra és/vagy a Tensilica DSP-k IR-jére. A Content Adaptive Machine Learninggel kezdtek, de van még ott más is.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Pahli

tag

Vagy csak aránytalanul több a power user amd oldalon és jobbak a hibák megtalálásában.

-

S_x96x_S

őstag

> OK, szóval pénzük nem lesz belőle

> és piaci részesedésük sem lesz belőle (az is pénznek számít).Ez mind-mind összefügg a Konzol Biznisszel ( "console SoCs" ) is

és ott sokat kaszál az AMD.

( jelenleg sokkal többet mint a "consumer GPUs"-on ! )A következő konzolgenerációra valószínüleg az Intel is rá-startol

( van gyára és most már ARC-os GPU-ja is )

és ha nem figyel az AMD, akkor az Intel viszi el a sajtot ..

És itt már minden apróság is számít ..

nem mindegy, hogy a nagyobb Game Engine-ek milyen alap-optimalizációval rendelkeznek.

És ha az AMD a szoftveres támogatással boldogabbá/hatékonyabbá tudja tenni a játékfejlesztőket, akkor ez a Microsoft-nál és a Sony -nál is jó pontnak számít.-------------

"It usually takes about four to five years to build an all-new CPU or GPU from scratch. So we seriously doubt that Microsoft and/or Sony ordered development of its next-generation console SoCs in 2019 or even 2020 without hearing feedback about their next generation hardware (PlayStation 5 and Xbox Series X|S) from game developers. Even if AMD is looking for an engineer to work on a console SoC now, that console SoC will hardly power a next-generation console but rather a mid-cycle update machine. Perhaps, Microsoft and/or Sony want to offer improved version(s) of their XBX and PS5 system(s) in circa 2024 ~ 2025 or just radically cut down their costs, which is why they need a new SoC. "

AMD's Console and GPU Team Hiring for Next-Generation SoCs

By Anton Shilov published May 13, 2022

Development of next-generation Xbox 5, PlayStation 6 console SoCs may be underway.

https://www.tomshardware.com/news/amd-console-gpu-team-hiring-verification-engineer-for-next-gen-socs> Az AMD 2021 közepén $4 milliárdos részvényvisszavásárlásba kezdett

> mert "nem tudta mire költeni a pénzt".

> Sztem jobb helye is lehetett volna annak a pénznek.az AMD-nek ( és minden publikus tőzsdei cégnek ) óvatosan kell ellensúlyozni

a hosszú távú technikai fejlesztések

és a tőzsdei részvény árfolyamok között ( ~ tulajdonosi értékteremtés )bármelyiket is elhanyagolja .. megszívja ...

És az AMD-nek is meg kell tartania a dolgozóit és a fejlesztőit és a vezetőket ...

amit nagyrészt dolgozói részvényvásárlási opciókkal oldanak meg,

amihez nem árt, hogyha a részvényárfolyam folyamatosan emelkedjen

még akkor is amikor válság van.

( ~ AMD’s ability to attract and retain qualified personnel )Ki tudja, hogy mivel csábította át Raja Koduri-t az Intel,

de a kompenzációs csomagban biztos volt egy hatalmas részvényopció is.Az Intel CEO-nak (Gelsinger) opciója is publikus

és a befektetők ezt egyértelműen a tudtára is adták hogy nem mindegy az árfolyam

"For Gelsinger to exercise his performance-based stock options, he must now increase Intel's stock price by 50 percent — rather than the original 30 percent figure — over the five-year period after he received the options. Furthermore, Intel's stock price must hold above that 50 percent threshold for 90 days instead of the original 30 days for Gelsinger to receive the payout." https://www.theregister.com/2022/11/23/intel_gelsinger_shares/Mottó: "A verseny jó!"

-

S_x96x_S

őstag

II.

> OK, szóval pénzük nem lesz belőle

> és piaci részesedésük sem lesz belőle (az is pénznek számít).a trend az, hogy az AMD ( és az INTEL is ) az nVidia piaci kiszorításán dolgozik.

Az AMD következetesen dolgozik a következő generációs APU-kon,

ami teljesen kiütheti az alsó és alsó-középkategóriás diszkrét GPU-kat.

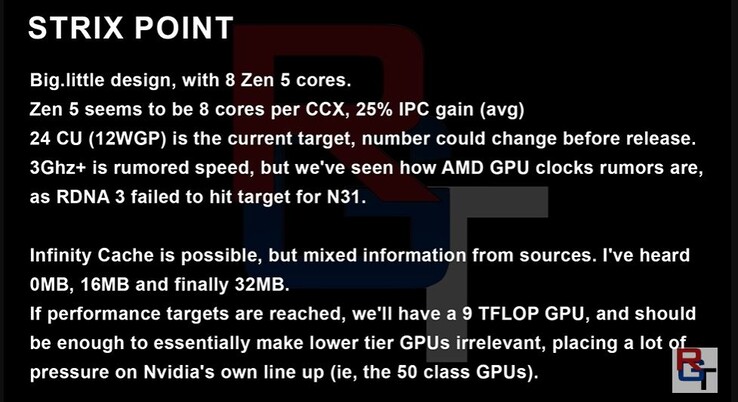

( vagyis az nVidia xx50 GPU családon ott a célkereszt ... )"Moving on to Strix Point’s RDNA 3+ iGPU, Paul suggests the GPU could feature up to 24 Compute Units and a 3 GHz+ clock speed. That said, the number of CUs isn’t final. Interestingly, Paul thinks the iGPU could make the lower-end discreet boards “irrelevant” with a minimum 9 TFLOPs of compute power if AMD meets the performance targets"

( via )amúgy a verseny jó!

[ Szerkesztve ]

Mottó: "A verseny jó!"

-

Abu85

HÁZIGAZDA

Driver téren abban járnak jól ezzel, hogy sokkal hatékonyabban fejlesztik magát a drivert az explicit API-kra. De ez nem csak ebből ered, hanem abból is, hogy az Intellel és az NV-vel ellentétben az AMD teljesen másképp írja meg a D3D12 és a Vulkan implementációt.

Például elég nagy különbség, hogy az Intelnek és az NV-nek külön rétege van mindegyik explicit API-ra. Tehát 100%-ban külön kódbázis a D3D12 és a Vulkan. Az AMD-nél nem így van. Ott egy közös réteg van, ami a PAL. Minden egyes explicit API erre a rétegre van húzva egy ICD-vel. Tehát a közös PAL-on fut a D3D12, a Vulkan és a Mantle ICD is. Emiatt az AMD nagyjából feleakkora erőforrás befektetésével is gyorsabban fejleszt, mint az NV és az Intel az explicit API-k támogatása kapcsán. Ezért van az, hogy nemhogy szűkülne az olló például az overhead kapcsán, hanem egyre csak nyílik szét.

Az Intelnél valószínűleg erre látunk majd megoldást a Battlemage bemutatkozásával, mert ők már javában dolgoznak azon, hogy összevonják az explicit API-s fejlesztési modellt úgy, ahogy az AMD csinálja. Raja kardoskodott nagyon, hogy inkább most kell váltani, mint később, mert soha az életben nem érik utol a Radeon meghajtók teljesítményét, ha nem térnek át ugyanarra a fejlesztési modellre. Most ugye ez az iparági mérce.

Ez az oka annak, hogy amíg az Intel és az NV az erőforrásaik közel 100%-át belenyomja a D3D12/Vulkan implementációkba (sőt, az Intel a D3D9-től konkrétan meg is vonta az erőforrást), addig az AMD annyi szabad kapacitása van, hogy újraírták mára a D3D11 és az OpenGL implementációjukat. Nem tudják hova rakni a szabad programozóikat, mert alig kell dolgozniuk az explicit API-s meghajtókon, miközben azok overheadben kb. utolérhetetlennek tűnnek.Nézd meg például a Plague Tale: Requiem esetében a meghajtók többletterhelését. [link] - És az AMD ezt a játékot nem is profilozta fel. Sose jött hozzá profilváltás, az egész az általános profilról megy. Mindez nagyrészt annak köszönhető, hogy a fejlesztők D3D12MA-t használnak, illetve az Asobo használta először az RPS-t, igaz nem a publikus verziót, hanem egy nagyon előzetes kiadást, amihez nyilván fejlesztőként hozzá tudtak férni. És ilyen körülmények mellett az Unreal Engine 4 működése annyira megváltozott, hogy az AMD-nek nem is kell rá dolgoznia a driver oldaláról, ami persze nagyrészt annak köszönhető, hogy a menedzsment kód, amit a játék használ 100%-ban az AMD-től származik. Gyakorlatilag ez felfogható úgy, hogy az AMD írta meg a játék teljesítménykritikus részeit, csak nem specifikusan, hanem egy általánosra fejlesztett kóddal.

Ezért akarta az AMD ezt az explicit API-ra való átállást, mert ők nagyon berendezkedtek erre. Tudják, hogy itt nem igazán a driveren múlik az egész, felesleges azt olyan extrém bonyolultra fejleszteni, amilyen bonyolultra csinálja például az NV a nagy overheadet adó emulációs rétegeivel. Csak a humánerőforrást viszi, és hozzáadott sebességet alig kínál, miközben lesz egy nagyon komplex kódod, amit aztán extrém drága fenntartani.

És ugye még reagálni kell arra is, hogy például egy 250 fős Asobo, amelyik nem kis fejlesztő, bár nyilván nem is übernagy, jobbnak érzi azt, hogy másfél év munka helyett egyszerűen elkérje az AMD menedzsment kódjait (vagy letöltse a GitHubról, ha már elérhetők), és azt beépítse a játékba, megspórolva ezzel másfél év optimalizálást, és minimum 10 programozó teljes másfél éves fizetését. Nem véletlen, hogy az Intel is elkezdte a saját dizájnjaira optimalizálni a D3D12MA/VMA kódokat a GitHubon, mert rájöttek, hogy ez olyan spórolást jelent kb. mindenkinek, hogy a jövőben a stúdiók 99%-a így fog dolgozni. Innentől kezdve pedig nekik is arra kell gyúrniuk, hogy a D3D12MA/VMA kódok out-of-box menjenek az Arcokon az általános meghajtóprofillal.Egyébként már programozói szemléletben is nagyon durván eltérnek a cégek explicit API implementációi. Amíg a hagyományos API-k kapcsán ez megegyező volt, addig az explicit API-k esetében az AMD a KISS szemlélettel dolgozik egy jó ideje, míg az NV és az Intel BDUF koncepcióval. Ez is mutatja, hogy mennyire nem volt egyértelmű, hogy mi lesz a jó. Egyébként első nekifutásra a "Big Design Up Front" nagyon is jónak tűnik az explicit API-kra. Olyannyira, hogy az AMD az első Mantle implementációnál is így dolgozott, csak a gyakorlatban rájöttek, hogy mennyire sok bajt okoz, amikor a tervek szintjén pöpecre megdizájnolt koncepciód elkezded leprogramozni, és bezuhan vele egy rakás desing flaw, amire rá kell rakni az erőforrást, hogy javítsd. Lásd az NVIDIA 384.76-os eszközillesztője, ami durván módosult, amikor egy korábban istenkirálynak tűnő rendszerről kiderült, hogy egyben egy durva desing flaw is, és hát utólag rendesen meg kellett kalapálni, hogy relatíve jó legyen. Az ilyen jellegű over-engineeringek jól működtek DirectX 11-gyel, de ritka rosszak explicit API-val. Ide úgy néz ki, hogy a Keep It Simple Stupid az optimális, annak ellenére, hogy szigorúan elméletben tényleg a BDUF tűnik jónak.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

S_x96x_S

őstag

> Ez tényleg egy olyan szitu, ami hosszútávon pénzt hoz a konyhára.

> Már ha igaz az, hogy az Intel is bele akar ugrani a konzolbizniszbe,

> én erről még nem láttam sehol szivárogtatást.

> Sztem előbb kéne írniuk egy normális drivert.elfogult vagy ..

![;]](//cdn.rios.hu/dl/s/v1.gif)

és szerintem erről nem kell szivárogtatás .. ( ez B2B )Az Intelnek van egy csomó gyára és jelenleg is próbálják nyomni a bérgyártást.

Nekem teljesen logikus, hogy az Intel Sales-ek megkeresik a Sony-t és a Microsoftot, hogy a következő konzolbiznisz felől érdeklődjenek és a sajt minél nagyobb darabkáját megszerezzék. ( gyártás, cpu, gpu )

Intel egyedüliként is indulhat, vagy az nVidiával ( gpu chipletével) együtt.És a Sony/Microsoftnak is érdeke, hogy legyen rivális az AMD mellett, hogy az AMD árait le tudják törni.

És még ha az Intel és az nVidia esélyei gyengék is, ők is felismerik azt, hogy csak úgy - küzdés nélkül - nem érdemes átadni a sajtot..

és a minimális stratégiai cél, hogy az AMD profit marzsát a lehető legkisebbre kell csökkenteni.. ( vagyis ne nagyon legyen tejszin és zsiradék abban a sajtban )meg amúgy is:

Intel CEO Says Open To Manufacturer AMD Chips At Their Fabs, Aim To Build The Fastest CPUs, GPUs & Discrete GPUs In The World

https://wccftech.com/intel-ceo-open-to-manufacturer-amd-apple-nvidia-qualcomm-chips-at-their-fabs-make-fastest-cpus-gpus-in-the-world/https://www.theverge.com/2022/10/4/23385652/pat-gelsinger-intel-chips-act-ohio-manufacturing-chip-shortage

The Verge:

"The flip side of this is not just in Nvidia but AMD as well. It’s in the two major consoles and the Steam Deck — basically, it is in everything except the Switch. Ryzen chips per dollar seem to be offering more performance, and there is a lot of back and forth between Intel and AMD. Is that just a crown you can take? Or are you saying, “At the end of the day, we are going to do Foundry Services, get that Intel logo on the side of the fab in Ohio, and it’ll be fine”?"Intel CEO, Pat Gelsinger:

"Hey, we are here to win in this space. Make no mistake about it. We are going to build the fastest high-performance computers in the world, the fastest GPUs in the world, and the fastest discrete GPUs in the world. We will have continuity to our integrated graphics as well. With increasingly integrated graphics in a heterogeneous architecture where you have multiple chiplets, just wait until you see Meteor Lake next year. These become quite interesting products, somewhat as Apple has shown. I see that continuity, and we are going to be very competitive.

At the same time, I’m going to be the foundry for Nvidia. By the way, they need a more resilient supply chain. They need these technologies that we are working on. I don’t know how much of it will win, but I want to win their business. I want to win Qualcomm’s business, and I want to win Apple’s business. We want to be that provider of a choice.

...."> szóval ez sztem nem az AMD melósairól szól, hanem ezekről a cégekről:

persze arról is szól,

de az AMD menedzsereinek és a melósainak is ...

pl. "AMD 2022 U.S. BENEFITS AT-A-GLANCE" -ben azért nevesítve van:

Employee Stock Purchase Plan (ESPP)

• Contributions up to 15% of salary for regular employees with at least one month of

service

• Six-month Offering Periods beginning May 9th and November 9th

• Purchase Price of 85%, the lower of closing price at beginning or end of Offering Period.az ESPP egy alternativ nyugdíjmegtakarítás is

és ilyen célból a belső dolgozói morálnak is jót tesz az emelkedő részvény árfolyam.[ Szerkesztve ]

Mottó: "A verseny jó!"

-

HSM

félisten

"Instabil alatt nemtom mire gondolsz"

Pl. 280X-ből volt jópár AIB típus, aminél a GPU alatti ramcsipre nem került hűtés, és rendszerint el is melegedett, ami miatt sok szemetelt ezek közül. 290-ekből is volt ramhűtés nélküli AIB, ott is a felhasználónak volt érdemes kicsit besegíteni a kártyának nem túlmelegedni... 5700-nál is volt pár 'érdekes' modell. Ezek nem segítenek építeni a bizalmat."Inkább a driverekkel volt/(van?) probléma."

Voltak bizonyos alaplapok, amiknél a zerocore módjuk után fekete képernyő jött, nem tért magához a GPU (volt aki írt is rá kis appot, ami meg tudta akadályozni ezt a módot). Na, aztán már mindenféle hibát ennek a számlájára írtak a fórumban, azt is, amiről ordított, hogy kártyahiba, de ugye a "fekete képernyős hiba" villant be..."2. átlag vásárló ha ilyet lát ... akkor kétségbeesettséget sejt emögött"

Nem tudom, én valószínűleg nem ilyen vagyok. Számomra a pl. zárt middleware-ek vagy zárt megoldások erőltetése a szabványok helyett, amire mint a versenyt potenciálisan csökkentő, a vásárlónak hátrányos dologként tekintek. -

Abu85

HÁZIGAZDA

Ez az Unreal Engine 5-ben nem jelent semmit, hiszen a Turingnak minden leíróhalmazban lévő erőforrás betöltése előtt register flush kell, ami azért szépen eszi a hardver teljesítményét (szar a motor kódja ilyen szempontból, nem jól kezeli a direkten regiszterbe dolgozó dizájnokat). A GCN-nek nem kell egyszer sem register flush. De persze az 55 fps így is sok az 580-nak.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Szerintem a linket megnézve ironizált csak

De persze a "register flush" nélkülözése miatt gyakorlatilag 200 FPS lenne a normális.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Szerintem biztos nem egyszintű a gond. Oda vezethető vissza, hogy a jelenlegi gazdasági körülmények között a kereskedők is elkezdtek biztonságra játszani. Ha valaminek az ára nem jó, és nem biztos, hogy eladható, akkor inkább nem rendelik meg. És ez nyilván rossz egy VGA-gyártónak, mert ott a raktárban a holmi, és mivel ott a holmi, így új GPU-t sem rendel, mert még a rég legyártott VGA-t sem adta el.

Erre a megoldás az lenne, ha lenne megegyezés arról, hogy ki vállalja fel a veszteséget, és akkor annyit csökkentenének az áron, hogy meginduljon a készlet. Nyilván nem fog ekkora készlet elmenni egy negyedév alatt, ahhoz le kellene írni az egészet, de apránként eladható úgy 4-5 negyedéven belül.

#59840 bjasq99 : Ezek dizájnkülönbségek lesznek. A Navi 31 eleve 6 darab shader motort használ. Ahhoz, hogy ezek működjenek egymás mellett nagyon vaskos buszrendszer kell.

A Navi 33 felépítése még rejtély, de az eddigi adatok alapján két shader motor lesz benne. Ehhez szimplán elég egy crossbar busz, és felesleges masszív HUB-ot építeni.Az, hogy régebben hogyan változott ez, szintén kizárólag a busztól függöt. Minden architektúra skálázható egy darabig, de egy ponton túl már sok tranyót fog elvinni a buszrendszer, és ez nem lineárisan nő.

#59843 Busterftw : Ha kiszeded a piac legnagyobb részét, vagyis a notikat, akkor leszelektálod olyanra, amilyenre akarod. Innentől kezdve azt is mondhatod, hogy nem érdekelnek a részesedések 1000 dollár alatt. Csak senki sem fog ilyen piackutatást csinálni. Az viszont tény, hogy a nagy mennyiségű eladás az nem az 5 nm-es GPU-k piacán történik. Ezek arányaiban nagyon keveset adnak bele az összeladásba. Ilyenekre a Mindfactory-hoz hasonló oldalak adnak valamennyire választ, de ez nehezen számít reprezentatívnak. [link]

#59846 Petykemano : Anyagilag ez mindenképpen egy bukós sztori lesz. Az a kérdés, hogy ki viseli majd a bukás nagyobbik részét. És ilyenkor megy a faszméregetés, hogy kié lankad le hamarabb.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

-

bjasq99

kezdő

Egy amolyan konyha matek mint amiket te szoktál végezni:

Ad102 alu száma: 18432 , tranya: 76.3 Mrd

Ga102 alu: 10752 , tranya: 28.3 Mrd

Az Ada nak 18432/10752=1.71 szer annyi tranyát kellene tartalmazzon ha lineárisan skálázodna minden (tudom Abu nem).

Tehát 1.71*28.3 = 48.5 Mrd tranzisztor kellene.

Na most vegyük bele az L2 cache tranzisztor igényét :

Mint máshol írtam 128 Mb cachet meg lehetne csinálni 6 Mrd tranyából, de mivel ez L2 cache és nagy buszokat tartanak neki fent így számoljunk a duplájával 12 Mrd tranzisztorral.

Igy is csupán 60.5 Mrd tranzisztor van meg a 76.3 -ból, pedig a cache-t illetően úgy érzem inkább felül becsültem tranya számban. -

PuMbA

titán

De veszel használtan olcsóbban RX6700XT-t, amin nem 8GB, hanem 12GB VRAM van...nem igazán értem, hogy mi lesz itt az alsó-középkategóriában. Hogy teszik ezeket a kártyákat vonzóvá? Az NVIDIA is úgy tűnik, hogy semmit nem képes mutatni ebben a fontos kategóriában.

[ Szerkesztve ]

-

Sajnos nem, a 6650XT jóval gyengébb a 3060Ti től is és kb 25-30 % kal a 6700XT től.

Az 300 Dollár alatt megvehető most is EU-ban 330€ az olcsóbb helyeken is de annyiért már van ARC 770 és és 380€ körül 3060Ti

Kb a 3060 Ti alá érkezik valahova, ha ez igaz, figyelmbe véve a kb egyenlő jelet.

Olyan 200 dolcsiért ok lenne.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Petykemano

veterán

Ja, jó hogy jössz.

Biztos emlékszel, hogy volt egy beszélgetésünk arról, hogy vajon az AMD tényleg annyival többször hibázik-e szoftveresen vagy máshogy, mint az Nvidia, vagy ez csupán egy illúzió, egy hamis kép, amit az alakít ki, hogy valamiért az AMD hibáira többen és jobban emlékeznek, míg az Nvidia hibái nincsenek úgy felkapva, és hamarabb elvesznek az emlékezetből.Az Nvidia driverében javításra került egy a Discord használatával összefüggő a GPU-t eközben lassító, amúgy hiba. [link]

A média beszámolt róla.

De tessék. Az AMD találgatós topik pár napja tele van azzal, hogy az AMD 1-2 hónapja nem adott ki friss drivert az RDNA2-höz. Itt van a Hogwarts Legacy játékkal kapcsolatos probléma (nemtudni mi végről ered) és ez is meg lett említve, hogy milyen szar.

Az előbb néztem az Nvidia találgatósba nem ment oda senki az ott lakók orra alá dörgölni, hogy na tessék, itt van a hibátlan driveretek. Nem állítom, hogy erre szükség volna. Csak arra próbálok rámutatni, hogy milyen okai lehetnek annak, hogy az a percepció alakul ki, hogy az AMD driver hemzseg a hibáktól és ezekre mindig mindenki emlékszik is, az NVidia meg hibátlan.

Találgatunk, aztán majd úgyis kiderül..

-

PuMbA

titán

Kijött a teljes HUB teszt. 1080p-ben az RX7900XTX gyorsabb az RTX4090-nél RT-vel, de 1440p-ben és 4K-ban decimálódik és az NVIDIA nagy előnybe kerül. Abu, azért gyorsabb az AMD 1080p-ben, mert a CPU limit kisebb ugye? A baj csak az, hogy felső kategóriás kártyáknál ez épp nem számít semmit, mert RX7900XTX-et nem 1080p-re vesznek. Ennek az előnye csak alsó-közép kategóriában lesz majd jelentős.

[ Szerkesztve ]

-

DudeHUN

senior tag

Őszre szerintem ez is olyan 200-220$ környéke lesz, ahova való. Az elnevezés alapján jó ugrás. Már persze, ha itt is lesz a kártyának XT permutációja. Mert ja. A fogyasztása nem jó.

Mondhatjuk, hogy Nvidia pofátlanabb. Mert ezzel a nevetséges árazással és felnevezéssel az. De AMD-t nézve sincs minek örülni jelenleg.

Mondjuk legalább az eladásaik szarok, hátha az hoz valami változást.[ Szerkesztve ]

Gamer for Life

-

PuMbA

titán

Nem lett olyan rossz, mint a 4060 Ti indulás, de az RDNA3 minimális előre lépésnek tűnik az RDNA2-höz képest. A 6600-hoz képest a sebesség előnye nagyrészt azért van, mert több a számolóegység, magasabb órajelen megy a GPU és a memória és nagyobb a TDP. Itt nincs 5nm, ami szépítené a dolgokat, mint a csúcskártyák esetén.

[ Szerkesztve ]

-

hahakocka

senior tag

Nem lehet hogy a 6nm-en való maradás miatt amúgy ez egy fèl Rdna3 genes kari kb? Ez olcsó volt Amd nek de nekünk nem sokat èr. Nem multi chiplettel jött mint a 7900xt . S emiatt ilyen rossz. A 4060-4060Ti teljes èrtèkű 4000 es kiadás? Gyak szinte csak egy húzott 6650xt 6 bánom. Nem tudja kamatoztatni a Rdna3 chiplet designt az 5 nano előnyeit stb

.[ Szerkesztve ]

-

S_x96x_S

őstag

> Drukkoljunk, hogy elbukjanak?

én drukkolok nekik ..

a verseny jó

.. és hátha az nVididából is még többet kiprésel.

... meg hátha az AMD is észbe kap és használható szoftver körítést ad, ha nem akar szégyenbe kerülni.valamint a jövőbeli laptopok egy része APU-val RDNA3 -as lesz.

vagyis ez nem csak a GPU-ról és a játékról szól.a verseny jó

[ Szerkesztve ]

Mottó: "A verseny jó!"

-

Abu85

HÁZIGAZDA

Nincs klasszikus 3rd party driver Radeonhoz. Igazából mindet az AMD fejleszti, csak valamelyik open source. Azért van kétféle meghajtó Linuxra, mert bizonyos technológiák licenckötelesek, így nem lehet őket open source projektben alkalmazni, tehát muszáj tartani hozzájuk egy zárt AMDGPU-PRO csomagot is. Viszont a fő projekt az open source már egy jó ideje, csak azok használnak zártat, akiknek AMDGPU-PRO-ban meglévő, open source-ba licencproblémák miatt nem átvihető technológiákra elengedhetetlenül szükségük van.

Az AI pedig nem csak GPU-s kérdés az AMD-nél, mert nekik azért sokkal átfogóbb a termékportfóliójuk, és egy csomó dologra a Versalt kínálják. Egyszerűen nem akarják, hogy ezek helyére GPU-kat vegyél, mert a Versal tizedannyit fogyaszt, és sokkal kisebb a késleltetés, ráadásul hússzor drágább, ami náluk profitként csapódik le, lásd embedded részleg profitja.

Majd a MI300 utódja fog ezen változtatni, amiben már CPU, GPU és ACAP is lesz egy tokozáson. Onnan veheted a komplett csomagot, mert eladják neked mindegyik komponenst, és nem tudsz mellé venni alternatívákat.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

S_x96x_S

őstag

> Én ezzel kapcsolatban szkeptikus vagyok:

> egy random cég ír egy szoftvert egy konkurens cég kártyájára:

> ez nem fogja az NV-t semmire sem kényszeríteni.A lehetőség benne van.

Gondold végig ..

ha emelkedik a konkurencia minősége ( ár/teljesítménye )

akkor az kihatással lehet az nVidia termékeinek keresletére is.És pont te irod:

> Viszont arra jó lesz, hogy azt a kártyát elkezdjék felvásárolni azok, akik ismerik ezt a

> szoftvert és AI-ban utaznak. Ha még kompatibilissá is teszik a többi RDNA3 kártyával,

> akkor mégrosszabb lehet a helyzet (a játékosok szempontjából).Az "elkezdjék felvásárolni .. RDN3.." ==> vagyis nem nVidiát vesznek

és ez pont kihatással lehet az nVidiára is.

(Elsőként az nVidia részvényesek fognak háborogni ... )

Mottó: "A verseny jó!"

-

Raggie

őstag

Fú, lehet ,hogy valami nagy arc és még igaza is van, de ettől a csávótól kiráz a hideg.

Soha nem láttem még videóját, de ezek után lehet nem is fogok megnézni tőle többet.

Irtózatosan idegesítő, kapkodó nem magyarázó és levegőbe beszélő ember... Ettől még lehet igaza van és okos, de akkor inkább írjon és ne videózzon, vagy nemtom.

[ Szerkesztve ]

Clint Eastwood FTW

-

Tom's szerintem korrektül leírta.a cikkben amit linkeltem.

A második chart amúgy nem annyira gáz mint az első, elfogadható, bár kicsit hülyére veszi az embereket.

Az első az úgy ahogy van szerintem gáz.

8 GB 3060 nem elterjedt változat és nem csak memóriában kevesebb, hanem sávszélben és teljesítményben is kb 15-20 % kal lassabb, mint a 12 GB verzió.

A 3060 12 GB is annyi vagy olcsóbb mint a 7600( alzánál 110 K ,7600 120 K) és átlagban 15 % van köztük, nem 34%. ( főleg hogy a COD kiemelkedően extra eredményt ad % különbség számolások tekintetében)

Nem véletlenül választotta a 3060 összehasonlításban a 8 GB verziót

3060 12 GB esetében, ami olcsóbb is mint a 7600, 15 % lenne azon a képen kb.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

jah ok bocs

Hosszú lesz ne haragudj:

Az 1060 -2060 nal való összevetés volt az első táblázat..

Az szerintem bullshit marketing hogy egy új kártyát ami egy brutálisan erős mezőnybe érkezett kissé túlórázottan és csalódás keltően azzal próbálsz eladni hogy 6-8 éves konstrukciókhoz méred a konkurenciánál ráadásul nics is igaza mert Nvidia oldalán jelenleg jobban jársz egy 3060 TI vel a régi genről is mint a7600 kártyával. Hülyének nézi a vásárlókat ezzel, hogy így próbálja jobb színben eladni ezt a kártyát.

Aki zöld oldalon akar áltani annak most ott a 3060 TI a 7600 árán vagy a 3060 olcsóbban több Vrammal.

Igen ez a god hogy a 6650XT és 3060 TI kimaradt a szórásból, pedig ez utóbbi az elmúlt 4 hétben a legjobb vétel lett szerintem FHD ra Nvidia oldaláról.Vegyük árban Alzát a legolcsóbb, bontatlan verziót mindegyikből és teljesítményben csak rasztert ( RT ne legyen most befolyásoló) Computerbase számait 1080 P re: + vramot[link]

-7600 -120 K( 100 % ár @100 perf, 8 GB Vram)

- 6650 98 K (82% ár 93% teljesítmény = Vram) =jobb

RX6700XT 145 K(+128% ár 116% teljesítmény+4 GB vram) = ?

RTX 3060 12 GB 110 K(92 % ár- 88 % teljesítény+4 GB Vram)= ?

3060 TI 127 K (105% ár + 17 % teljesítmény = Vram) = jobbtehát ha valaki régi genről akar váltani olcsóbb és gyorsabb megoldást is talál.

Jelenleg Nvidia oldaláról a 3060 Ti 5 % árért + 17 % teljesítményt kínál a 7600 hoz ézve.

A 6650XT meg olcsóbban jobb árértéket ad, alig van lemaradása

Szóval az ilyen chartokkal aza gond, hogy egy vezető AMD-s marketinges muksó nézi hülyére a saját felhasználóit, mert a jelenlegi genben a 6650XT jobb perf et kínál, 3060 8 % kal olcsóbban 12 GB vramot jobb RT teljesítményt és DLSS-t kínál cserébe 12 % kal lassabb , a 3060 Ti meg mindenben jobb legyen perfarány vagy teljesítmény.

Tehát ha valaki fejleszt a 12 GB os 3060 nal szemben szerintem így sem sokan választanák azt a 3060 Ti - 6650XT- 6700 sorozat teljesen kifogta a szelet a vitorlából külföldön is meg itthon is.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Persze hogy nem fogja azt reklámozni de chartot Nvidia oldalra hegyezte ki és ezért dobta ki az első után a második, 3060 8 GB összehasonlítás

Mindkét chart a zöld oldalt célozta és a régi generációról való váltást.

összefügg a kettő csak a másodiknál az új generációban már a 3060 8 GB verziót tette be nem véletlenül. Ezért írtam hogy aki váltani akar annak ott a 3060 12 GB és a 3060 Ti is amivel szemben a 7600 ra váltás szerintem elvetendő a régi generációról.AMD ről mega 6650 olcsóbban vagy a 6700-6700XT hiába drágább vagy lassabb egyik vagy másik. Ezt ő is tudja, ezért talált rá megoldást.

Szóval egy szelektív marketing.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- Autós topik

- AMD Ryzen 9 / 7 / 5 / 3 5***(X) "Zen 3" (AM4)

- Képeken az egyik kameráját elvesztő Sony Xperia 10 VI

- HiFi műszaki szemmel - sztereó hangrendszerek

- Az Apple megszerezné a klubvilágbajnokság közvetítési jogait

- Gitáros topic

- Azonnali VGA-s kérdések órája

- Végre megjelenési dátumot kapott az xDefiant

- Kerékpárosok, bringások ide!

- Apple iPhone 15 Pro Max - Attack on Titan

- További aktív témák...

Állásajánlatok

Cég: Promenade Publishing House Kft.

Város: Budapest

Cég: Ozeki Kft.

Város: Debrecen

Tehát minél több erőforrást meg tudnak spórolni a teljesítménycentrikus kódokkal, és a hatékonyabb fejlesztési modellel, annál több újítást tudnak hozni a driverbe. Ez különösen fontos manapság, hogy hozzáférnek egy rakás Xilinx technológia forráskódjához, amelyből elkezdtek szelektálni, hogy mit portoljanak át PAL-ra és/vagy a Tensilica DSP-k IR-jére. A Content Adaptive Machine Learninggel kezdtek, de van még ott más is.

Tehát minél több erőforrást meg tudnak spórolni a teljesítménycentrikus kódokkal, és a hatékonyabb fejlesztési modellel, annál több újítást tudnak hozni a driverbe. Ez különösen fontos manapság, hogy hozzáférnek egy rakás Xilinx technológia forráskódjához, amelyből elkezdtek szelektálni, hogy mit portoljanak át PAL-ra és/vagy a Tensilica DSP-k IR-jére. A Content Adaptive Machine Learninggel kezdtek, de van még ott más is.

![;]](http://cdn.rios.hu/dl/s/v1.gif)