Új hozzászólás Aktív témák

-

KTTech

veterán

Mázlista.. nekem az utolsó 2 kártyám GPU hibával halt meg (egy MSI 770Lightning és egy 1080 Seahawk)... (valószínű mindkettőnél eltört 1-2 forrasztás a panelen). Az utóbbi alig egy hete adta meg magát... ez egy jel, hogy ideje az upgrade-nek, csak még nem tudom 3070 vagy 3080 legyen.

www.kttech.hu //A szgépem/fényképezőm configja az adatlapomon

-

yagami01

aktív tag

-

Az oké, de az ára lesz igazán érdekes. AZ a baj, hogy én nehezen tudom elképzelni, hogy annyival olcsóbban tudja adni az AMD az RTX 3070-nél, hogy inkább azt vegyük.

Nexus 5x > Pixel 4a 5G \\ AMD Ryzen 5800X3D - Gainward RTX 3070 Phoenix \\ Asus Zenbook 14 Oled UM3402YA \\ Playstation 5 \\ DJI Mavic Mini \\ Nintendo Switch Neon v2 \\ Steelseries Arctis Nova 7 \\ Steam/Origin/Epic Games Store/GoG/Ubi Connect: Hopkins955

-

Kansas

addikt

Először a 3070 hozzon 2080Ti szintet RT nélkül, utána megnézhetjük, mit tud a Big Navi... majd egy hónappal később, mikor megjelenik.

Úgy egyszerűbb 2080Ti szintet hozni, ha RT be van kapcsolva, és az Ampere jelentősen kevesebb teljesítményt bukik vele... egyelőre a raszterizálást használó játékok nagyságrendileg többen vannak, mint a sugárkövetésesek, jobban számít, azokban mekkora a teljesítménye az Ampere-eknek...Csak gondolatkísérlet:

Korábbi kártya teljesítménye legyen 100 raszterizálással.

Új generációs kártya legyen 120 szintén raszterizálással.

Régebbi kártya bukik RT bekapcsolással 50%-ot, lesz neki a teljesítménye 50.

Új kártya bukik RT bekapcsolással 25%-ot, lesz neki a teljesítménye 90.

Hoppá, így lesz az eredetileg +20% teljesítményelőnyből hirtelen +80% csak attól, hogy be lett kapcsolva az RT... és szerintem ez a példa nem feltétlenül áll extrém messze a valóságtól...[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Malibutomi

nagyúr

2080ti szintet mar januari leakben a korai fos tesztkartya joval felulmulta.

2080ti-t 2db 5700xt is hozza multigpu-ban ami nem epp a legjobb skalazodas.

Egy rdna1 chip ami ketszer akkora mint az 5700 xt lenne 2080ti felett. De most rdna2 jon ha minden igaz joval magasabb orajelekkel is, es ujabb architekturan.

De ez mar ki lett beszelve parszor

-

Kansas

addikt

Ez most nem fog tetszeni neked, de megmondom én, szerintem miért jön ez elő újra és újra...

Hallottál már Ferrari tulajdonost azon nyafogni, hogy mennyibe kerül az új modell? No, ezért...

[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Kansas

addikt

Nyafogni tipikusan az a réteg szokott, akinek az igénye meglenne, csak a pénze nincs.

Kicsit tudathasadásos dolog ez:

Egyrészt nyugodtan, bánom is én kinek mi az igénye, ha megengedheti magának, vegye meg azt' használja egészséggel az igényéhez illő terméket...

Másrészt, amíg van aki bármennyibe kerül is, megveszi, addig nem lesz árcsökkentés és ha nem is normális, de norma lesz a félmillás árazás...

Ráadásul nem a félmillás VGA ára a legbotrányosabb, hanem a kézszázezresé... ami az első bányászláz előtt még százért vehető volt... Az RX480-am másfél évvel a megvétele után többet ért(többe került használtpiacon), mint újkorában

Harmadrészt, a nagyigényűek egy jelentős hányada igazából nem olyan nagy igényű - kíváncsi lennék, vakteszten hányan vennék észre játék közben(nem állóképen nagyítóval) a különbséget egy mai játékban a High/Very High/Ultra beállítás közt, vagy a 130 vs 240 fps közt... inkább csak a tudat kell, hogy "nekem minden Ultrán megy"...Bár ha azt nézed, pl. a 3090 az a Titan RTX utóda, ezer dodóval olcsóbban, és csak az ára miatt gondolkodik mezei user a megvételében, mert a 2080Ti kezdőára környékére lőtték be. Tehát akár örülni is lehetne, hogy ez a generáció olcsóbb az elődénél...

Ráadásul vannak azok mint én is, aki rendszeresen jóval a valódi igénye fölötti képességű VGA-t vesz, mert 2-3-4-5 évig nem szeretné cserélni... realisztikusan nekem elég lenne egy 1660Super vagy egy 5600XT FHD-ra, nem kellett volna 5700XT-t venni, csak akkor cserélgethetném egy-másfél évente... lehet is, hogy átállok erre, bár nyilván e-hulladék szempontjából nem optimális hozzáállás, és abban se vagyok biztos, hogy mindent egybevéve olcsóbb... utána kéne egyszer számoljak.

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

edward2

addikt

Igen a szokásos dolgokat végig zongoráztam. Cache időt nyomtam pár tízezerig de semmi. Aztán írtak olyat, hogy valtoztassak output modult defaultról dx10re vagy 9re vagy opengl stb. Már nem emlékszem,de eddig semmi sem segített.

Amúgy amit ricsip ír nekem ilyen gyanúm van, hogy valahogy HDDről mintha x időnként lenne valami jitter.[ Szerkesztve ]

-

MegalodonS

őstag

Mert azert itt mas tortent!! 5 perc alatt elfogyott a keszlet EU es USA-ban es volt akinek a vasarlas kozben eltunt a kartya, uj vasarlasnal mar out of stock volt!! Kozben az ebay-re megjelentek a nagy aru 3080 kartyak!!

To stop bots and scalpers on the NVIDIA store, we’re doing everything humanly possible, including manually reviewing orders, to get these cards in the hands of legitimate customers.

Azert lehet ez mond valamit

[ Szerkesztve ]

-

BiP

nagyúr

Oké, de ugye a kiindulópont az volt, hogy FullHD mellett mire használható egy 3080.

Nyilván, akinek van 4K monitora, az nem fogja fullHD-n nyomni 4x-es DSR mellett

(#1949) Pug: Az, mert még az említett 3070 is overkill FullHD-ra. De még FullHD 144Hz-re is. Azt még egy 1080Ti is lehozza.

[ Szerkesztve ]

-

Laraxior

titán

A Crysis remastered pl nincs meg a 60FPS 1080p-ben.

De a régi sem tudja a 2070Superemmel 4K-ban a 60FPS-t.

[ Szerkesztve ]

- Konfig 1.0: Z790F, 14700KF, 32GB, RTX4090, Thor 1200W, 7000D, Odyssey G9 49" oled - Konfig 2.0: x299 Dark, 9980XE, 48GB, 1080HoF, EVGA 850W, Z906, S90C 77" oled

-

Nyilván ha monitorok között is nyitott a kérdés, akkor más a leányzó fekvése. A magasabb render / leskálázás kombónak akkor van értelme, ha adott pl. egy fHD monitor, és egy olyan VGA, ami kényelmesen renderel 4K-ban is. Akkor a VGA sokkal többet melózik, hogy az fHD monitoron valamivel jobb legyen a képminőség.

Pedro... amigo mio... ma is konzervvért iszunk! Kár lenne ezért a tehetséges gyerekért...

-

Nem tudom, hogy akarsz egy ilyen kérdésben objektív lenni, amikor nulla adattal rendelkezel. Kb. azt tudod összehasonlítani, hogy mennyi postot láttál arról, hogy valakinek sikerült / nem sikerült cuccot venni. Nekem a Pascal startnál sem rémlik, hogy több lett volna a sikeres vásárló.

Ami most valóban súlyosbítja a helyzetet, az a bot attack a Founders kártyák rovására. Ott lássuk meg, lesz-e tényleg lépés az NVIDIA oldaláról, vagy csak marketingrizsa volt, hogy megvizsgálják a tranzakciókat.Pedro... amigo mio... ma is konzervvért iszunk! Kár lenne ezért a tehetséges gyerekért...

-

Laraxior

titán

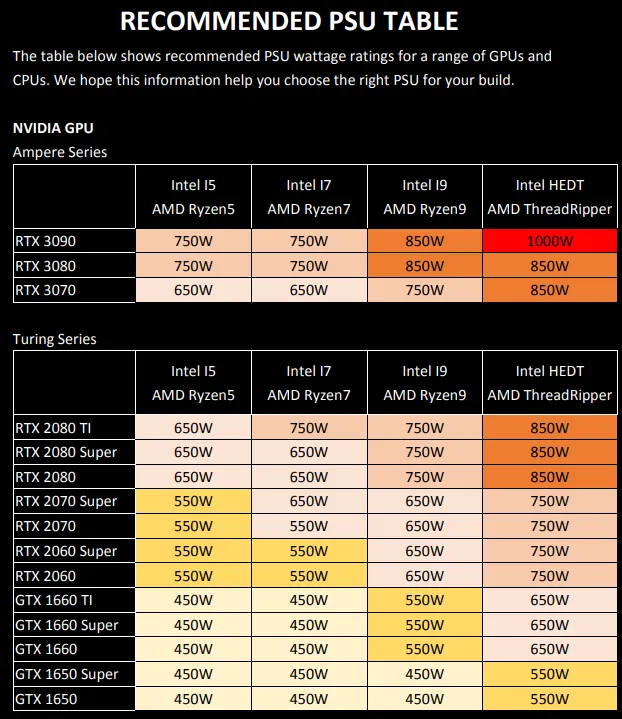

En anno 600 wattnyi peak fogyasztast porgettem vigan egy VX550-assal.

...és milyen egészséges is az a tápnak... főleg, ha kicsit hosszabb távra tervez(ne) vele az ember.

Az én tápjaim világéletükben lábat lóbáltak, mert rá volt hagyva bőven. Ezért üzemel még a TX650-em is így 10+ év távlatból is.

Nem véletlenül ajánlanak nagyobb tápot. El lehet lenni a kisebbel is, de a tartalék sosem baj.(#2047) gbors: ...és mit csinálnak azzal aki 42db FE-t vett? Visszaveszik tőle?

[ Szerkesztve ]

- Konfig 1.0: Z790F, 14700KF, 32GB, RTX4090, Thor 1200W, 7000D, Odyssey G9 49" oled - Konfig 2.0: x299 Dark, 9980XE, 48GB, 1080HoF, EVGA 850W, Z906, S90C 77" oled

-

Laraxior

titán

Csak a VGA eszik 350W-ot... némelyik 3080 el lesz engedve 370-ig is...

Egy lazább játék alatt nekem 160W-ot eszik a CPU...és akkor még nincsen mellette a szivattyú, ventik. HDD, SSD, ingyombingyom...- Konfig 1.0: Z790F, 14700KF, 32GB, RTX4090, Thor 1200W, 7000D, Odyssey G9 49" oled - Konfig 2.0: x299 Dark, 9980XE, 48GB, 1080HoF, EVGA 850W, Z906, S90C 77" oled

-

Laraxior

titán

...és szerinted mennyi hardver van az ilyen tesztgépekben? A kötelezőn kívül semmi.

Nekem van 5 SSDm, 2 winyom, hangkártya, szivattyú, millió ventilátor.

CPU:170W, GPU: 215W Ez már majdnem 400W... és a VGAm csak 2070S.

Az 1080Ti-m úgy beszívta a 350W+-t mint a huzat. Azzal már mindjárt 500W felett vagy CPU és VGA részről.- Konfig 1.0: Z790F, 14700KF, 32GB, RTX4090, Thor 1200W, 7000D, Odyssey G9 49" oled - Konfig 2.0: x299 Dark, 9980XE, 48GB, 1080HoF, EVGA 850W, Z906, S90C 77" oled

-

Jacek

veterán

Neked is ott vannak a képek

Egy példát mondanék te melyik autót vennéd hogy 120-al menj.

1: 600 ccm 5000rpm fordulat és megy 120-at minek nagyobb...

2: 1600ccm 2000rpm fordulat és megy 120-al ez is...

Jó vásárlást.. Tőlem 450-es táppal is lehet próbálkozni, nekem idáig is 1000 táp volt ami 550-ig passivan üzemel, ez bevallom kicsit túlzás valóban de egy 750-es táp azért illő lenne, aztán nehogy olyan peakok legyenek mint a Vega64-nél, ha ez előfordul gondolom itt fogsz hamut szórni a fejedre

-

Kaci84

őstag

Teljesen egyett tudok érteni. Állandóan megy ez a túlméretezés, hogy " majd a jővőre" gondolva. Alapból nem értek ezzel egyett, de az más tészta. A 650W táp bőven elég, pláne ha igazán jó gyártmány. A 650-es táp azért 650-es, mert ennyi leadott áramot kell tudjon. Oké nem jó annyira ha 100-on mennyen folyamatosan, de azért hagy egyrészt a gyártó is ráhagyást, meg a Juzer is. Találgatni is felesleges a Juzernek kellene összeadni milye van. Nagyon nagy szakadék lehet a szénné húzott 9900K közt meg az alapon járatott 7700 között mondjuk. Használok fogymérőt, de mindig sokkal kevesebb a valós fogyasztás amit a Júzerek tippleni szoktak, több gépen is mértem. Játszottam 1070SLI-vel és a felvett áram 270-290W volt.

[ Szerkesztve ]

-

Jacek

veterán

Valamiért nem reagáltál az álltalam linkelt képekre, mitől lehet ez ? Gondoltam ha te ennyire szakmai vagy akkor elmagyarázod mért is vágod te ezt jobban mint a teszteket készítő oldalak

Példával próbáltam lemenni kutyába de nem sikerült eléggé, hogy én mért így hasznélom azt is ignoráltad

az álltalam linkelt teszteket meg ignorálod a saját véleményedet semmivel nem támasztod alá a csakon kivűl

az álltalam linkelt teszteket meg ignorálod a saját véleményedet semmivel nem támasztod alá a csakon kivűl  Köszönjük...

Köszönjük...Legviccesebb hogy az Nvidia is 750-et mond de te persze ennél is okosabb vagy

A táp összesítő tomshardver gondolom ő összejátszik a tápgyártókkal nem azért ajánl olyan ami biztosan jó nem 599 fogyasztáshoz vegyünk 600w-os tápot mert a gyártó hagy benne. hát ez nagyon szakmai, de várom a szakmai érveidet

[ Szerkesztve ]

-

edward2

addikt

Tehát egy bemutatott HP/Dell/Lenovo ryzen laptop közel 7-8 hónapig elérhetetlen az kinek a hibája? Azt ne mond nekem, hogy egyik gyártó se hajlandó gyártani a laptopot. Közben intel bejelenti az új laptop procit és pár héten belül kapható több konfigban mindegyik gyártónál.

Összeesküvés elmélet? Intel lefizeti a laptop gyártókat? Vagy az AMD képtelen valóban procit gyártani a partnereknek (vagy drivert vagy mittomén mit)

Tényleg kíváncsi vagyok mit gondolsz, mert a két oldalt nézve hétköznapi szemlélőként nekem ebből az AMD bénázása jön ki egyértelműen.

-

-

lacus83

senior tag

Ha megnézed a h.a. akkor az eladó 2080Tikből látszik van itt még jó pár tehetős a fórumon.

De elég az is ha átugrasz a 3080 topikba mennyien vesznek majd kártyát,szóval van itt zsé sok mindenkinél,de lehet csak mindenki hazudik

MSI B460 Tomahawk,I5 10400F Box,G.Skill Tident Z 2X8 Gb 3000Mhz RGB,Megahalems Cooler,LIANLI Lancool III,Samsung 860 Evo 256GB ,Toshiba P300 3TB,LC Power 600W,ASUS ProArt 4060,LG 27GL850B

-

kolopele

nagyúr

Majd amikor olvasod a tesztet róla, kicsit lejjebb veszed az agarakat. Nem veszem meg a Ventust, kivárok, nem hajt a tatár, Ráadásul úgy néz ki, alig 10% az előnye a 3090 - nek a 3080 - al szemben, szóval még bármi lehet. Az meg, hogy te mit gondolsz, gondolom tudod, mennyire érdekel.

[ Szerkesztve ]

-

AsakuraDave

őstag

Hát sales manager-nek se téged fognak alkalmazni az tuti

![;]](//cdn.rios.hu/dl/s/v1.gif) Kereslet/kínálat...

Kereslet/kínálat...

Szomorú dehát már jó régóta fogyasztói társadalomban élünk...

Hagyjuk az aprós "nepper" árakat, nézzük csak a bolti árakat.There's only one thing that hurts people more than lies. It's saying out loud the truth and facts.

-

Alogonomus

őstag

Akkor minden ferrari/porsche/bentley/mclaren és egyéb tulajdonost is utálsz, mert van képük megvenni annyiért az autót, és amiatt nem adják olcsóbban a luxusautókat?

Az persze másik kérdés, hogy akinek bedől az ilyen hitele, azt nem kellene mindenféle moratóriumokkal megmenteni.

-

kolopele

nagyúr

Elhiszed, hogy nem érdekel? Pénz kérdése minden, akinek nincs, annak minden fáj.

Nite: Rossz a felfogásod nagyon ezen a téren. Kb. 1 éve nyúzom 4k - n a 2080 Ti - t, és már nem tudta tartani a 60 fps - t sem az újabb játékoknál. Én nem fogok várni azért, hogy majd másnak legyen olcsóbban. Az én pénzem, én kerestem meg rá, arra költöm amire akarom![ Szerkesztve ]

Új hozzászólás Aktív témák

ph Sajnos a technikai specifikációkkal nagyon szűkmarkúan bánt a cég, így az érkező VGA-k pontos képességei még ismeretlenek.

- Sub-ZeRo: Euro Truck Simulator 2 & American Truck Simulator 1 (esetleg 2 majd, ha lesz) :)

- Poco X6 Pro - ötös alá

- Adatmentés - HDD - SSD - Flash

- E-roller topik

- Lakáshitel, lakásvásárlás

- Motorola Moto G24 Power - hol van az erő?

- Kodi és kiegészítői magyar nyelvű online tartalmakhoz (Linux, Windows)

- Van, amit nehéz lett megtalálni a Google keresőjével

- f(x)=exp(x): A laposföld elmebaj: Vissza a jövőbe!

- Kínában túl sok az EV, fokozódik az árháború

- További aktív témák...

- PowerColor RX 6800 XT Red Dragon 16GB GDDR6 256bit - Számla + Garancia, Ár alatt! BeszámítOK!

- 4070 Ti Aorus Master //KERESEM!!//

- MSI GeForce RTX 3090 24GB GDDR6X 384bit (RTX 3090 SUPRIM X 24G) videokártya

- BESZÁMÍTÁS! Gigabyte AORUS MASTER RX 6800XT 16GB GDDR6 videokártya garanciával hibátlan működéssel

- ZOTAC RTX 3070 8GB GDDR6 Twin Edge OC Eladó! 118.000.-

De természetesen legyünk zöldek, mentsük meg a Földet meg minden. Kiváncsi lennék hány ilyen hipokrita libbant klímavitéz csap le első nap a kártyára mint gyöngytyúk a takonyra.

De természetesen legyünk zöldek, mentsük meg a Földet meg minden. Kiváncsi lennék hány ilyen hipokrita libbant klímavitéz csap le első nap a kártyára mint gyöngytyúk a takonyra.

.

.

![;]](http://cdn.rios.hu/dl/s/v1.gif) Kereslet/kínálat...

Kereslet/kínálat...