-

GAMEPOD.hu

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#17779

üzenetére

Jack@l

#17779

üzenetére

A DXR nem a DirectX, hanem a DirectCompute API kiterjesztése. DirectX 13-nak biztos nem fogják nevezni, mert semmiféle specifikációt nem változtat meg a DirectX API-n belül. Igazából köze nincs a kettőnek egymáshoz. Technikai értelemben nem is egy API, hanem egy speciális gyorsítókönyvtár a DirectCompute API-hoz.

(#17778) Petykemano: Igen, zsák a foltját.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Jack@l

veterán

válasz

Jack@l

#17981

üzenetére

Jack@l

#17981

üzenetére

UI: Viszont találtam ezzel kapcsolatban egy elég érdekes cuccot

http://linuxgizmos.com/tiny-carrier-unleashes-nvidia-xavier-power-for-robotics-and-ai/

Vajon ki fog készíteni cserélhető videókaris konzolt először?

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#18009

üzenetére

Jack@l

#18009

üzenetére

Attól függ, hogy milyen magot használsz. Egy Cortex-A76, már erősen az AMD és az Intel friss magjai környékén van. Persze ennek a hátránya, hogy a fogyasztása is jelentősen megnő, de nyilván a teljesítmény nincs ingyen. És ebbe már lehet valamekkora SVE-t is rakni, mert ARMv8.2a az ISA.

Az ARM host processzor mindenképpen segítene az NV-nek egy lapalapú memóriamenedzsmentet biztosítani PC-re, mert tudnák támogatni a GPU-ból az ARM memóriamodelljét. A többi annyira még nem fontos, de mondjuk a Microsoft-féle Tiled Resources Tier_4-re már NVLink kell nekik is, azt pedig nem fogja támogatni az AMD és az Intel, tehát muszáj maguknak gondoskodni róla. Az AMD és az Intel arra fog törekedni, hogy a saját GPU-juk legyen ott a CPU mellett a tokozáson, a saját memóriakoherens összeköttetéseikkel (GMI és UPI ugye).

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#18014

üzenetére

Jack@l

#18014

üzenetére

A memóriakoherencia hiánya a gond. Az NVLink, a GMI és az UPI nem véletlenül memóriakoherens. Önmagában nem lenne ebből baj, ha megegyeznének a gyártók egy szabványban. Például a CCIX tökéletes lenne a PCI Express helyére, de valamiért egyik gyártó sem érdekelt abban, hogy a jövőben a hardvereiket keverhetővé tegyék. Emiatt mindenki csinált magának saját interfészt, és cserébe a másikét nem is támogatják.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

válasz

Jack@l

#18014

üzenetére

Jack@l

#18014

üzenetére

Kevered a dolgokat és ez sajnos elég naív elképzelés.Elég kevés esélyt látok a jövőre nézve ( mondjuk 4-5 év múlva ) hogy a jelenlegi formában megmaradjon a dedikált GPU CPU vonal gaming szegmensben.

Nvidia kényszer pályán van a jövőre nézve,mert nem fogják egymás megoldásait támogatni, erről szól a versenypiac sajnos. Saját megoldásaikat fogják nyomatni, azaz vegyél Intel CPU-t intel GPU val és ugyan ez igaza Vörösökre is.Szóval ezért örülök, hogy ARM ilyen erősen fejleszt és ott lohol Intel nyakában és hogy Microsoft Intel legnagyobb bánatára támogatja őket mert amúgy ez a topik lehúzhatja a rolót pár éven belül, legalább is gaming szegmensben.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

válasz

Jack@l

#18018

üzenetére

Jack@l

#18018

üzenetére

ebből szinte semmi nem igaz sajnos amit leírtál föleg az ARM 5 éves lemaradását vizionálni,mikor sok szempontbol már Intel elött járnak. de ezt itt hagyjuk is annyiba.Abu el tudná neked jobban is magyarázni ezt, mint én de nem akarok ebben a topikban a témába jobban belefolyni.Én olvasok sok más oldalt is és tudom a raytracinget is meg hasonló csak ennek abszulút nincs köze a témához szintén, azt se tudom honnan keverted ide. Mindegyik gyártónak meg lesz / van a saját raytracing eljárása a Microsoft felé, ez sem egy egységes elképzelés, kivéve annak, hogy végeredmény szempontjából minek kell megfelelniük, de ennek végrehajtása megint gyártó szintű megoldást kíván, csak úgy mint az egybetokozott hardverekkel bejövő jövőkép,amiben sok általad is felsorolt eszköz egy fedél alatt fog muzsikálni,söt,még a memoriát is betolják alá pár éven belül.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#18018

üzenetére

Jack@l

#18018

üzenetére

Az ARM már nagyon közel van. Mondom, hogy a Cortex-A76 egy AMD/Intel csúcsmagjait megközelítő fejlesztés. Ezzel már az AVX-re is lehet reagálni, ami az ARM-nál az SVE. Csak ugye a korábbi magokba ezt nem lehetett beépíteni. És az SVE az olyan, amitől eléggé fosik az Intel és az AMD is, mert a kialakítása miatt csúnyán körbe tudja húgyozni az AVX-et. Szóval az az 5 év jó lesz 5 hónapnak. Majd a Fujitsu Post-K projektje fogja megmutatni, hogy milyen bivalyerős az ARM koncepciója. Szimplán CPU-ból kitolják 2020 után az exaflops-ot. A többiek ehhez gyorsítózni fognak.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#18049

üzenetére

Jack@l

#18049

üzenetére

A PCI Express nem fog eltűnni. Egy rakás komponens erre van bekötve. A probléma az vele, hogy teljesítményben marhára kevés lesz egy GPU-nak, nem véletlen, hogy iszonyatosan megindította a tempóboostot a PCI-SIG, illetve nem memóriakoherens az interfész. Ezek miatt a hiányosságok miatt már az NV, az Intel és az AMD is rendelkezik saját alternatívával, amelyek ráadásul nem csak gyorsabbak, de memóriakoherensek is.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#18051

üzenetére

Jack@l

#18051

üzenetére

Azért elhanyagolható a különbség, mert a fejlesztők nem túráztatják a PCI Express buszt a teljesítménylimitációk miatt, de ha mondjuk elnézel a GDC-re, akkor elég sokan mondják már a gyártók közül is, hogy a fejlesztők panaszkodnak, hogy bizonyos újításokat nem tudnak bevetni a PCI Express sebessége miatt. Ezek léteznek a stúdióknál, csak áll bennük a pénz, mert valós környezetben még nem kihasználhatók. Ugyanakkor mégis fejlesztik őket, mert látják, hogy az Intel, az AMD és az NV is rendelkezik saját megoldássokkal a PCI Express helyére.

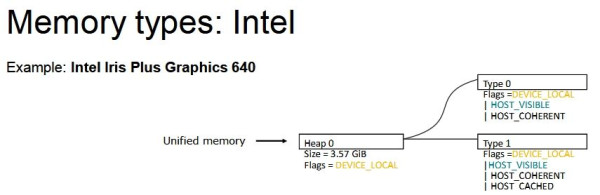

Memóriakoherencia bizonyos IGP-knél van, ezekre fejlesztik a fenti újításokat, csak itt meg a teljesítmény hiányzik, tehát ebből a szempontból is meg vannak lőve. De mondjuk egy Kaby Lake-G elég lenne, ha a CPU és a GPU memóriakoherens interfészen lenne összekötve. Na és ki fejleszt bevallottan pont ilyet? Csak nem az Intel? Nyilván mindegyik cég látja ezt, és reagálni fognak rá a megfelelő hardverekkel. Már minden komponens megvan hozzá házon belül. A Microsoft is fedi le az API-ban a problémát a Tiled Resources Tier4-gyel.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

válasz

Jack@l

#18049

üzenetére

Jack@l

#18049

üzenetére

PCIE kihalása vs csökkentése illetve a sávok elvétele két különböző dolog.Az első mostanában nem fog bekövetkeznia második pedig akár pár generáción belül eljöhet.Az utóbbi kb az a kategória, mikor egy Bugattival 80 nal vereted az autópályán.ITt a probléma az hogy erre a megoldást INtel sokkal könnyebben abszolválja, mint NV.

Sokszor hallottam már az IT iparban az elmúlt 20 évben, hogy ez és az kizárt hogy bekövetkezzen. aztán lám...[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Crytek

veterán

válasz

Jack@l

#18382

üzenetére

Jack@l

#18382

üzenetére

Jézus...az a lavinás video komoly? Annak mi értelme volt? Avalance studio 75x szebbet produkál a saját enginejével min 2x gyorsabban...ez valami ocsmány... Vagy az volt a cél hogy direkt lassan minél ocsmányabbat?

A csávós videó szép de ha ez a 2x2 terület is ilyen gépigényes.....khm nem tudom miben fogják használni ezt...meg hány 10 év múlva.

[ Szerkesztve ]

Next PC Upgrade: 2022

-

Televan74

nagyúr

válasz

Jack@l

#18418

üzenetére

Jack@l

#18418

üzenetére

Ok, akkor marad a sznobság faktor számomra,mint elfogatható tény a más elnevezésre.Nekem RTX -.em,neked meg csak egy kis GTX -ed!

![;]](//cdn.rios.hu/dl/s/v1.gif)

Bár nem lehet még tudni mi áll a koncepció mögött,vagy csak egy marketinges agymenésről van szó. Vagy csak én képzelek túl sokat a dolog mögé.Majd kiderül.Abu85 Köszönöm a hosszas okítást. Sajnos még mindig nem kaptam választ arra a feltevésemre,hogy miért kell külön elnevezni. GTX(2060) -re és RTX(2070) -re,ha mind a kettő tudja azt amit leírtál.

[ Szerkesztve ]

Amikor nincs remény! Jusson eszedbe nincs isten, csak én!

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#18476

üzenetére

Jack@l

#18476

üzenetére

Vertex adatokhoz nem. Eleve hülyeség lenne, hiszen a csúcspontok csak pozíciók az adott objektum köré vont "hálós dobozon" belül. Mindegyik vertexhez külön letárolni a skálázást float kitevőként iszonyatos erőforrás-pazarlás, mert szebb nem lesz, de durván több memóriát fog zabálni.

Mivel a DXR specifikációja kizárja a 32 bites snorm formátumot, így bizony csúnyán megnő a geometria memóriaigénye. Még akkor is, ha az RT effekteket nem kapcsolod be.

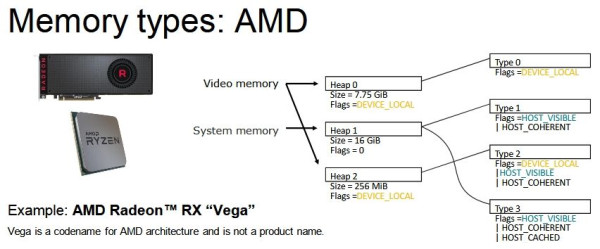

A Frostbite motor memóriavezérlése miatt. [link] - itt leírtam, hogy az IHV-k implementációi a strukturális memóriakezelésre vonatkozóan egészen különböznek, vagyis amikor írnak egy vezérlést egy motorba, akkor nem egy IHV-re dolgoznak, hanem megpróbálnak egyfajta közös alapot találni. Ez bizonyos hardvereknél kisebb vagy nagyobb memóriapazarláshoz vezet, de itt a cél a teljesítmény szinten tartása. Érti egyébként a Frostbite Team is, hogy ez egy probléma, de rohadt nehéz ám segíteni rajta. Az AMD részben emiatt fejlesztette ki a HBCC-t. Nem akarják, hogy a rossz programkódok lerontsák a hardver teljesítményét, így amit a fejlesztők most szoftverből csinálnak, azt a Vega óta inkább megcsinálják maguk hardverből. Jobban bíznak magukban, mint a játékfejlesztőkben. Azt hiszem, hogy abban egyetérthetünk, hogy nem teljesen alaptalan az AMD meglátása, legalábbis figyelembe véve, amit eddig láttunk az DX12 API-nál a memória kezelése kapcsán.

A Frostbite Team átválthatna Vulkan API-ra, ott van dedikált allokáció, az megoldaná a gondjaikat. Nem szép megoldás, de működik.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#18656

üzenetére

Jack@l

#18656

üzenetére

Ez erősen játékfüggő.

Nem downclockolnak semmit. Ennyit bír a dizájn, illetve a Hynixtől 14 Gbps-os memóriákat vesznek. A Samsung 16 Gbps-osakat árul, de nem tudja ezt az órajelet a memóriavezérlő és a tervezett NYÁK.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Crytek

veterán

válasz

Jack@l

#19016

üzenetére

Jack@l

#19016

üzenetére

Sejthető volt ,hogy nem fél év alatt lett ez a dolog. De jó már 2 játékban lesz belőle valami... ha 1080ti-m lenne tuti nem cserélném le akkor sem főleg hogy lassan itt a 7nm ami jóval erősebb lesz.

Mondjuk a metroról sem láttam még vs videot ahol ray tracing és nélküle lévő grafikát és fpst láttunk.... Bár ha olyan lesz mint a dx 12 akkor nem sok vizet fog zavarni.

Next PC Upgrade: 2022

-

Jack@l

veterán

válasz

Jack@l

#19711

üzenetére

Jack@l

#19711

üzenetére

UI: egy 1080ti-nek 15x nagyobb a sima fp32 performance-a, mint a videóban a gtx285-nek (RT gyorsítás nélkül)

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

-

Puma K

veterán

válasz

Jack@l

#19699

üzenetére

Jack@l

#19699

üzenetére

"2012-ben physx+raytracing

https://youtu.be/h5mRRElXy-w"

Na ezt hiányolom... hol a bármilyen szinten is rombolható környezet...?

[ Szerkesztve ]

"Cuccok: csattogós lepke és tiki-taki" └[ʘヘʘ]┘

-

rup1u5

nagyúr

válasz

Jack@l

#19719

üzenetére

Jack@l

#19719

üzenetére

2009-es Red Faction Guerilla elég élvezetes rombolást produkált és nem kellett hozzá erőmű sem. Crysis első részében is nagyon jó volt a fizika. Azóta majdnem 10 év eltelt és semmi fejlődést nem láttunk a fizika terén, sőt inkább visszafelé lépkedtek a fejlesztők.

Why don't you knock it off with them negative waves!

-

-

Shaq-34

csendes újonc

válasz

Jack@l

#19893

üzenetére

Jack@l

#19893

üzenetére

Fel, legújabb windows update kell hozzá valamint a Developer Mode-t engedélyezni kell. Most sajnos nem vagyok a "dolgozó" gépemnél, ha megvan a csomag írok.

-

válasz

Jack@l

#20078

üzenetére

Jack@l

#20078

üzenetére

Nem is mondtam hogy fikázod, vagy ez nem tudom honnan jött,

Csak írtam , hogy a host szerver is szar volt, látszik. Gondolom ilyen béta cucc még.

Csak írtam , hogy a host szerver is szar volt, látszik. Gondolom ilyen béta cucc még.

Azt hittem ezt a dx 12 megakadás dolgot megoldották már, kb 1 éve nem vettem elő a Battlefieldet.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Jack@l

veterán

válasz

Jack@l

#20314

üzenetére

Jack@l

#20314

üzenetére

Még a Titan V-t belerakhatták volna a maga kis 11500-as score-jával.

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

-

válasz

Jack@l

#20568

üzenetére

Jack@l

#20568

üzenetére

[link]Az összes videójuk ilyen már régóta a csatornájukon, [link]ezt a dizájnt használják. Egyébként látványos.persze lehet ,hogy kamu, de a Deus ex eredményt látva nem hinném, látszik, hogy driver gond volt.Itt van tőlük még egy videó.[link]

És itt a GTX 1080 hoz nézve. [link] Itt 50-60 % körüli az előrelépés,van ahol több is pl Destiny 2, Hitman, alatt béta driverekkel.

Kár hogy elárazzák, nem lenne ez rossz gen.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#20593

üzenetére

Jack@l

#20593

üzenetére

[link] - időről-időre felüti a fejét. Nagyon random, azóta se tudják, hogy pontosan mi okozza (nyilván sejteni nem elég a javításhoz), de folyamatosan örökli mindegyik Frostbite játék a BF4 óta.

DX11 alatt nem is az alkalmazás felel a memóriamenedzsmentért. Nem a kapacitás vagy a hardver a probléma, hanem az, hogy egy sok-sok éve írt Mantle kód van DX12-re portolva. És ha átváltasz DX12-re, akkor bizony ettől tapasztalhatsz akadásokat, lagokat, elvégre a Mantle eleve nem támogatott sima eszközlokális memóriát, mindegyik látható volt a host számára. Ez baj, mert ilyet a DX12 alatt a VGA-k nem igazán támogatnak. Átírni meg ezt azért nagyon melós úgy, hogy évente kér több Frostbite játékot az EA. A szoftveres memóriamenedzsmentje a játéknak sajnos nem igazán jó, és ezt vagy megkerülöd a DX11-gyel, vagy a HBCC-vel. A 14 GB HBCC azért kellhet, mert ott érzi magát optimálisan a BF1. Nem nyers kapacitás kell neki, hanem az, hogy a teljes host visible flages memória biztosan HBCC szegmensen belül legyen a rendszermemóriában. A minimum ~11,5 GB mellett ~1 GB kicsúszhat ebből és nem HBCC által menedzselt területre kerül, ami azt jelenti, hogy ennek az allokációit folyamatosan be kell másolni a HBCC szegmensen belülre.

A Frostbite alatt alapvetően nem a hardverek jelentik az igazi korlátot. A motornak vannak nehezen javítható köhögőrohamai. Ezt megkerülni tudja némelyik hardver, de megoldani nem. A Frostbite Team tudná megcsinálni, ha az EA mondjuk adna nekik másfél évet, hogy akkor írják át, és jövőre nincs új Battlefield vagy Battlefront, de gondolom a részvényesek sikítva ordítják ilyenkor, hogy [link]. Szóval végeredményben csak cipelik a rendszer problémáit.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

huskydog17

addikt

válasz

Jack@l

#20671

üzenetére

Jack@l

#20671

üzenetére

"DirectX 12 Is a Stuttery Mess"

"Using DX12 the game suffered major stuttering with both AMD and Nvidia GPUs. This is something we saw with Battlefield 1 upon release, so we guess it’s not entirely surprising."

És ez a világ egyik legfejlettebb grafikus motorjától. Úgy tűnik a BF5 sem fogja javítani a DX12 már így sem túl fényes hírnevét.

Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#20681

üzenetére

Jack@l

#20681

üzenetére

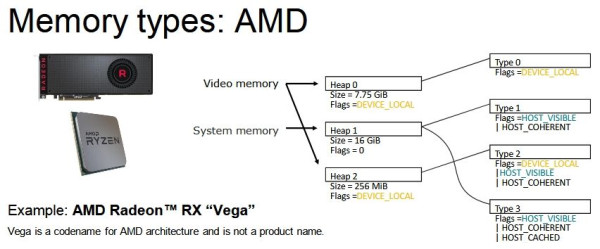

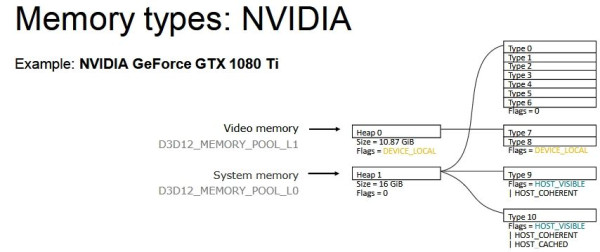

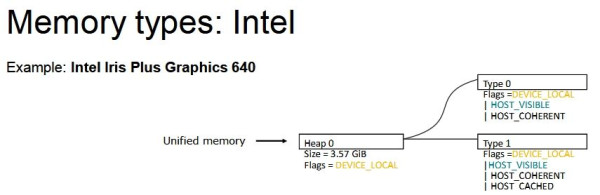

DX12-ben a GeForce-okon 0 MB-nyi a VRAM-on az a terület, ahova host visible flaggel menthetők pufferek. A Radeonon ez 256 MB-nyi, de amúgy ez sem elég, 100-150 MB-ot mindenképpen a RAM-ba kell menteni, mert nem férsz bele 256 MB-nyi host visible típusba a VRAM-on belül.

Az a baj, hogy csak a hardvert nézitek, amin van 6-8-10-akárhány GB, de igazából kitörölheti a Frostbite ezzel a seggét, ha ebből csak 256, vagy rosszabb esetben 0 MB, az ahova a CPU direkte írhat puffert. Márpedig a Mantle miatt a Frostbite eleve úgy lett felépítve, hogy ezt a fajta CPU ír a VRAM-ba, a GPU pedig olvas modellt követi. Csak annyi változott, hogy amíg Mantle esetében a teljes VRAM host visible volt, addig a DX12 és a Vulkan ezt nem igazán szereti. És persze visszavették ezeket a puffereket 300-400 MB-nyira, de ettől még ott vannak, és az olvasásukhoz a rendszermemóriáig kell vágtatni.

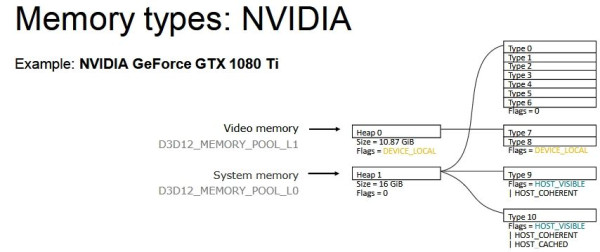

Amikor a DX12-t nézitek, akkor érdemes inkább ezt nézni, mert nem a nyers mennyiség határozza meg igazán a működést, hanem a memória strukturális felbontása:

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az NVIDIA éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- Gainward RTX 4070 Ghost 12 GB felbontott videókártya, 36 hó garancia, Áfá-s számla

- Sapphire RX 5700 XT nitro+

- BESZÁMÍTÁS! Bontatlan RADEON RX 6600 8GB / RX 6700 XT 12GB videokártyák számlával 3 év garanciával

- ASUS ROG Strix GeForce GTX 1060 OC 6GB GDDR5 192bit /Gyári állapot/Csavarmatrica/Beszámítás/

- ASUS RTX 3060 Ti 8GB GDDR6 TUF GAMING OC Eladó! 92.000.-

Állásajánlatok

Cég: Alpha Laptopszerviz Kft.

Város: Pécs

Cég: Ozeki Kft.

Város: Debrecen

![;]](http://cdn.rios.hu/dl/s/v1.gif)